Ошибки, встроенные в систему: их роль в статистике

Время на прочтение

6 мин

Количество просмотров 14K

В прошлой статье я указал, как распространена проблема неправильного использования t-критерия в научных публикациях (и это возможно сделать только благодаря их открытости, а какой трэш творится при его использовании во всяких курсовых, отчетах, обучающих задачах и т.д. — неизвестно). Чтобы обсудить это, я рассказал об основах дисперсионного анализа и задаваемом самим исследователем уровне значимости α. Но для полного понимания всей картины статистического анализа необходимо подчеркнуть ряд важных вещей. И самая основная из них — понятие ошибки.

Ошибка и некорректное применение: в чем разница?

В любой физической системе содержится какая-либо ошибка, неточность. В самой разнообразной форме: так называемый допуск — отличие в размерах разных однотипных изделий; нелинейная характеристика — когда прибор или метод измеряют что-то по строго известному закону в определенных пределах, а дальше становятся неприменимыми; дискретность — когда мы чисто технически не можем обеспечить плавность выходной характеристики.

И в то же время существует чисто человеческая ошибка — некорректное использование устройств, приборов, математических законов. Между ошибкой, присущей системе, и ошибкой применения этой системы есть принципиальная разница. Важно различать и не путать между собой эти два понятия, называемые одним и тем же словом «ошибка». Я в данной статье предпочитаю использовать слово «ошибка» для обозначения свойства системы, а «некорректное применение» — для ошибочного ее использования.

То есть, ошибка линейки равна допуску оборудования, наносящего штрихи на ее полотно. А ошибкой в смысле некорректного применения было бы использовать ее при измерении деталей наручных часов. Ошибка безмена написана на нем и составляет что-то около 50 граммов, а неправильным использованием безмена было бы взвешивание на нем мешка в 25 кг, который растягивает пружину из области закона Гука в область пластических деформаций. Ошибка атомно-силового микроскопа происходит из его дискретности — нельзя «пощупать» его зондом предметы мельче, чем диаметром в один атом. Но способов неправильно использовать его или неправильно интерпретировать данные существует множество. И так далее.

Так, а что же за ошибка имеет место в статистических методах? А этой ошибкой как раз и является пресловутый уровень значимости α.

Ошибки первого и второго рода

Ошибкой в математическом аппарате статистики является сама ее Байесовская вероятностная сущность. В прошлой статье я уже упоминал, на чем стоят статистические методы: определение уровня значимости α как наибольшей допустимой вероятности неправомерно отвергнуть нулевую гипотезу, и самостоятельное задание исследователем этой величины перед исследователем.

Вы уже видите эту условность? На самом деле, в критериальных методах нету привычной математической строгости. Математика здесь оперирует вероятностными характеристиками.

И тут наступает еще один момент, где возможна неправильная трактовка одного слова в разном контексте. Необходимо различать само понятие вероятности и фактическую реализацию события, выражающуюся в распределении вероятности. Например, перед началом любого нашего эксперимента мы не знаем, какую именно величину мы получим в результате. Есть два возможных исхода: загадав некоторое значение результата, мы либо действительно его получим, либо не получим. Логично, что вероятность и того, и другого события равна 1/2. Но показанная в предыдущей статье Гауссова кривая показывает распределение вероятности того, что мы правильно угадаем совпадение.

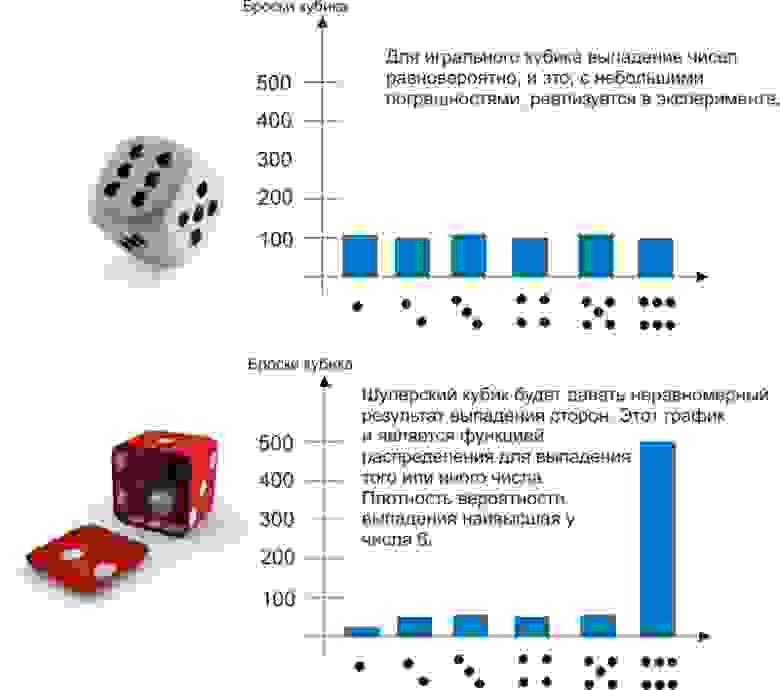

Наглядно можно проиллюстрировать это примером. Пусть мы 600 раз бросаем два игральных кубика — обычный и шулерский. Получим следующие результаты:

До эксперимента для обоих кубиков выпадение любой грани будет равновероятно — 1/6. Однако после эксперимента проявляется сущность шулерского кубика, и мы можем сказать, что плотность вероятности выпадения на нем шестерки — 90%.

Другой пример, который знают химики, физики и все, кто интересуется квантовыми эффектами — атомные орбитали. Теоретически электрон может быть «размазан» в пространстве и находиться практически где угодно. Но на практике есть области, где он будет находиться в 90 и более процентах случаев. Эти области пространства, образованные поверхностью с плотностью вероятности нахождения там электрона 90%, и есть классические атомные орбитали, в виде сфер, гантелей и т.д.

Так вот, самостоятельно задавая уровень значимости, мы заведомо соглашаемся на описанную в его названии ошибку. Из-за этого ни один результат нельзя считать «стопроцентно достоверным» — всегда наши статистические выводы будут содержать некоторую вероятность сбоя.

Ошибка, формулируемая определением уровня значимости α, называется ошибкой первого рода. Ее можно определить, как «ложная тревога», или, более корректно, ложноположительный результат. В самом деле, что означают слова «ошибочно отвергнуть нулевую гипотезу»? Это значит, по ошибке принять наблюдаемые данные за значимые различия двух групп. Поставить ложный диагноз о наличии болезни, поспешить явить миру новое открытие, которого на самом деле нет — вот примеры ошибок первого рода.

Но ведь тогда должны быть и ложноотрицательные результаты? Совершенно верно, и они называются ошибками второго рода. Примеры — не поставленный вовремя диагноз или же разочарование в результате исследования, хотя на самом деле в нем есть важные данные. Ошибки второго рода обозначаются буквой, как ни странно, β. Но само это понятие не так важно для статистики, как число 1-β. Число 1-β называется мощностью критерия, и как нетрудно догадаться, оно характеризует способность критерия не упустить значимое событие.

Однако содержание в статистических методах ошибок первого и второго рода не является только лишь их ограничением. Само понятие этих ошибок может использоваться непосредственным образом в статистическом анализе. Как?

ROC-анализ

ROC-анализ (от receiver operating characteristic, рабочая характеристика приёмника) — это метод количественного определения применимости некоторого признака к бинарной классификации объектов. Говоря проще, мы можем придумать некоторый способ, как отличить больных людей от здоровых, кошек от собак, черное от белого, а затем проверить правомерность такого способа. Давайте снова обратимся к примеру.

Пусть вы — подающий надежды криминалист, и разрабатываете новый способ скрытно и однозначно определять, является ли человек преступником. Вы придумали количественный признак: оценивать преступные наклонности людей по частоте прослушивания ими Михаила Круга. Но будет ли давать адекватные результаты ваш признак? Давайте разбираться.

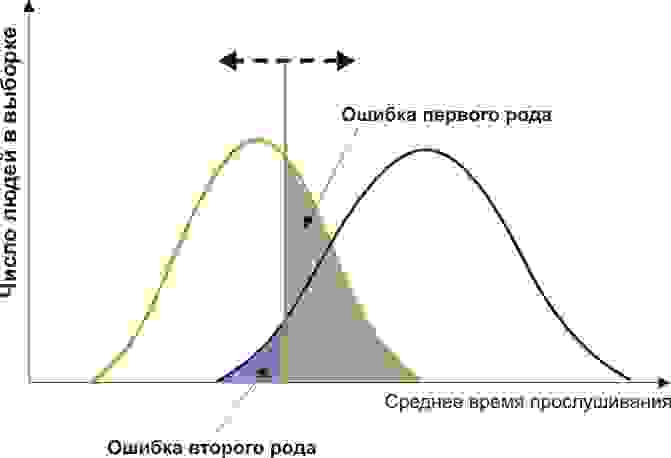

Вам понадобится две группы людей для валидации вашего критерия: обычные граждане и преступники. Положим, действительно, среднегодовое время прослушивания ими Михаила Круга различается (см. рисунок):

Здесь мы видим, что по количественному признаку времени прослушивания наши выборки пересекаются. Кто-то слушает Круга спонтанно по радио, не совершая преступлений, а кто-то нарушает закон, слушая другую музыку или даже будучи глухим. Какие у нас есть граничные условия? ROC-анализ вводит понятия селективности (чувствительности) и специфичности. Чувствительность определяется как способность выявлять все-все интересующие нас точки (в данном примере — преступников), а специфичность — не захватывать ничего ложноположительного (не ставить под подозрение простых обывателей). Мы можем задать некоторую критическую количественную черту, отделяющую одних от других (оранжевая), в пределах от максимальной чувствительности (зеленая) до максимальной специфичности (красная).

Посмотрим на следующую схему:

Смещая значение нашего признака, мы меняем соотношения ложноположительного и ложноотрицательного результатов (площади под кривыми). Точно так же мы можем дать определения Чувствительность = Полож. рез-т/(Полож. рез-т + ложноотриц. рез-т) и Специфичность = Отриц. рез-т/(Отриц. рез-т + ложноположит. рез-т).

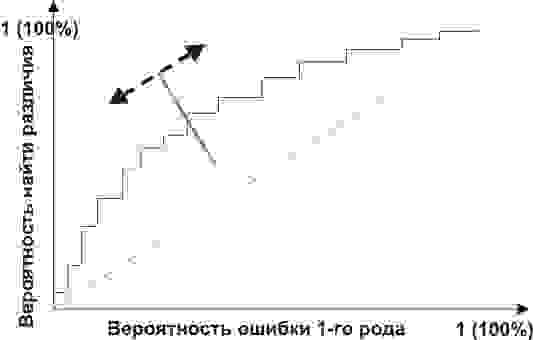

Но главное, мы можем оценить соотношение положительных результатов к ложноположительным на всем отрезке значений нашего количественного признака, что и есть наша искомая ROC-кривая (см. рисунок):

А как нам понять из этого графика, насколько хорош наш признак? Очень просто, посчитать площадь под кривой (AUC, area under curve). Пунктирная линия (0,0; 1,1) означает полное совпадение двух выборок и совершенно бессмысленный критерий (площадь под кривой равна 0,5 от всего квадрата). А вот выпуклость ROC кривой как раз и говорит о совершенстве критерия. Если же нам удастся найти такой критерий, что выборки вообще не будут пересекаться, то площадь под кривой займет весь график. В целом же признак считается хорошим, позволяющим надежно отделить одну выборку от другой, если AUC > 0,75-0,8.

С помощью такого анализа вы можете решать самые разные задачи. Решив, что слишком много домохозяек оказались под подозрением из-за Михаила Круга, а кроме того упущены опасные рецидивисты, слушающие Ноггано, вы можете отвергнуть этот критерий и разработать другой.

Возникнув, как способ обработки радиосигналов и идентификации «свой-чужой» после атаки на Перл-Харбор (отсюда и пошло такое странное название про характеристику приемника), ROC-анализ нашел широкое применение в биомедицинской статистике для анализа, валидации, создания и характеристики панелей биомаркеров и т.д. Он гибок в использовании, если оно основано на грамотной логике. Например, вы можете разработать показания для медицинской диспансеризации пенсионеров-сердечников, применив высокоспецифичный критерий, повысив эффективность выявления болезней сердца и не перегружая врачей лишними пациентами. А во время опасной эпидемии ранее неизвестного вируса вы наоборот, можете придумать высокоселективный критерий, чтобы от вакцинации в прямом смысле не ускользнул ни один чих.

С ошибками обоих родов и их наглядностью в описании валидируемых критериев мы познакомились. Теперь же, двигаясь от этих логических основ, можно разрушить ряд ложных стереотипных описаний результатов. Некоторые неправильные формулировки захватывают наши умы, часто путаясь своими схожими словами и понятиями, а также из-за очень малого внимания, уделяемого неверной интерпретации. Об этом, пожалуй, нужно будет написать отдельно.

Выдвинутая

гипотеза может быть правильной или

неправильной, поэтому возникает

необходимость ее проверки. Поскольку

проверку производят статистическими

методами, ее называют статистической.

В итоге статистической проверки гипотезы

в двух случаях может быть принято

неправильное решение, т. е. могут быть

допущены ошибки двух родов.

Ошибка

первого рода состоит

в том, что будет отвергнута правильная

гипотеза.

Ошибка

второго рода состоит

в том, что будет принята неправильная

гипотеза.

Вероятность

совершить ошибку первого рода принято

обозначать через ;

ее называют уровнем значимости. Наиболее

часто уровень значимости принимают

равным 0.05 или 0.01. Если, например, принят

уровень значимости, равный 0.05, то это

означает, что в пяти случаях из ста мы

рискуем допустить ошибку первого рода

(отвергнуть правильную гипотезу).

Пусть

дана выборка из

неизвестного совместного распределения,

и поставлена бинарная задача проверки

статистических гипотез:

где —нулевая

гипотеза,

а —альтернативная

гипотеза.

Предположим, что задан статистический

критерий

,

31. Статистический критерий проверки нулевой гипотезы.

Для

проверки нулевой гипотезы используют

специально подобранную случайную

величину, точное или приближенное

распределение которой известно. Эту

величину обозначают через U или Z, если

она распределена нормально, F или v2 – по

закону Фишера-Снедекора, T – по закону

Стьюдента, c² – по закону «хи квадрат»

и т. д. Все эти случайные величины

обозначим через К.

Статистическим

критерием (или

просто критерием)

называют случайную величину К, которая

служит для проверки нулевой гипотезы.

Для

проверки гипотезы по данным выборок

вычисляют частные значения входящих

в критерий величин, и таким образом

получают частное (наблюдаемое) значение

критерия.

Наблюдаемым

значением Кнабл назначают

значение критерия, вычисленное по

выборкам.

32. Критическая область. Область принятия гипотезы, критические точки.

После

выбора определенного критерия множество

всех его возможных значений разбивают

на два непересекающихся подмножества,

одно из которых содержит значения

критерия, при которых нулевая гипотеза

отвергается, а другое – при которых

она принимается.

Критической

областью называют совокупность значений

критерия, при которых нулевую гипотезу

отвергают.

Областью

принятия гипотезы (областью допустимых

значений) называют совокупность

значений критерия, при которых

гипотезу принимают.

Основной

принцип проверки статистических гипотез

можно сформулировать так: если наблюдаемое

значение критерия принадлежит критической

области – гипотезу отвергают, если

области принятия гипотезы – гипотезу

принимают.

Так

как критерий K – одномерная случайная

величина, то все ее возможные значения

принадлежат некоторому интервалу и,

соответственно, должны существовать

точки, разделяющие критическую область

и область принятия гипотезы. Такие

точки называются критическими точками.

Различают

одностороннюю (правостороннюю и

левостороннюю) и двустороннюю критические

области.

Правосторонней

называют критическую область, определяемую

неравенством ,

где–

положительное число.

Левосторонней

называют критическую область, определяемую

неравенством ,

где–

отрицательное число.

Двусторонней

называют критическую область, определяемую

неравенствами ,

где.

В частности, если критические точки

симметричны относительно нуля,

двусторонняя критическая область

определяется неравенствамиили

равносильным неравенством.

Различия между вариантами критических

областей иллюстрирует следующий

рисунок.

Рис.

1. Различные варианты критических

областей a) правосторонняя, b) левосторонняя,

с) двусторонняя

Резюмируя,

сформулируем этапы проверки статистической

гипотезы:

Формулируется

нулевая гипотеза ;

Определяется критерий K, по значениям

которого можно будет принять или

отвергнутьи

выбирается уровень значимости;

По уровню значимости определяется

критическая область; По выборке

вычисляется значение критерия K,

определяется, принадлежит ли оно

критической области и на основании

этого принимаетсяили

.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Ошибки первого рода (англ. type I errors, α errors, false positives) и ошибки второго рода (англ. type II errors, β errors, false negatives) в математической статистике — это ключевые понятия задач проверки статистических гипотез. Тем не менее, данные понятия часто используются и в других областях, когда речь идёт о принятии «бинарного» решения (да/нет) на основе некоего критерия (теста, проверки, измерения), который с некоторой вероятностью может давать ложный результат.

Содержание

- 1 Определения

- 2 О смысле ошибок первого и второго рода

- 3 Вероятности ошибок (уровень значимости и мощность)

- 4 Примеры использования

- 4.1 Радиолокация

- 4.2 Компьютеры

- 4.2.1 Компьютерная безопасность

- 4.2.2 Фильтрация спама

- 4.2.3 Вредоносное программное обеспечение

- 4.2.4 Поиск в компьютерных базах данных

- 4.2.5 Оптическое распознавание текстов (OCR)

- 4.2.6 Досмотр пассажиров и багажа

- 4.2.7 Биометрия

- 4.3 Массовая медицинская диагностика (скрининг)

- 4.4 Медицинское тестирование

- 4.5 Исследования сверхъестественных явлений

- 5 См. также

- 6 Примечания

Определения[править | править исходный текст]

Пусть дана выборка

где

,

сопоставляющий каждой реализации выборки

- Распределение

выборки

соответствует гипотезе

, и она точно определена статистическим критерием, то есть

.

- Распределение

выборки

соответствует гипотезе

, но она неверно отвергнута статистическим критерием, то есть

.

- Распределение

выборки

соответствует гипотезе

, и она точно определена статистическим критерием, то есть

.

- Распределение

выборки

соответствует гипотезе

, но она неверно отвергнута статистическим критерием, то есть

.

Во втором и четвертом случае говорят, что произошла статистическая ошибка, и её называют ошибкой первого и второго рода соответственно. [1][2]

| Верная гипотеза | |||

|---|---|---|---|

|

|

||

| Результат применения критерия |

|

верно принята верно принята |

неверно принята неверно принята (Ошибка второго рода) |

|

неверно отвергнута неверно отвергнута (Ошибка первого рода) |

верно отвергнута верно отвергнута |

О смысле ошибок первого и второго рода[править | править исходный текст]

Как видно из вышеприведённого определения, ошибки первого и второго рода являются взаимно-симметричными, то есть если поменять местами гипотезы

С учётом этого ошибку первого рода часто называют ложной тревогой, ложным срабатыванием или ложноположительным срабатыванием — например, анализ крови показал наличие заболевания, хотя на самом деле человек здоров, или металлодетектор выдал сигнал тревоги, сработав на металлическую пряжку ремня. Слово «положительный» в данном случае не имеет отношения к желательности или нежелательности самого события.

Термин широко используется в медицине. Например, тесты, предназначенные для диагностики заболеваний, иногда дают положительный результат (т.е. показывают наличие заболевания у пациента), когда на самом деле пациент этим заболеванием не страдает. Такой результат называется ложноположительным.

В других областях обычно используют словосочетания со схожим смыслом, например, «ложное срабатывание», «ложная тревога» и т.п. В информационных технологиях часто используют английский термин false positive без перевода.

Из-за возможности ложных срабатываний не удаётся полностью автоматизировать борьбу со многими видами угроз. Как правило, вероятность ложного срабатывания коррелирует с вероятностью пропуска события (ошибки второго рода). То есть: чем более чувствительна система, тем больше опасных событий она детектирует и, следовательно, предотвращает. Но при повышении чувствительности неизбежно вырастает и вероятность ложных срабатываний. Поэтому чересчур чувствительно (параноидально) настроенная система защиты может выродиться в свою противоположность и привести к тому, что побочный вред от неё будет превышать пользу.

Соответственно, ошибку второго рода иногда называют пропуском события или ложноотрицательным срабатыванием — человек болен, но анализ крови этого не показал, или у пассажира имеется холодное оружие, но рамка металлодетектора его не обнаружила (например, из-за того, что чувствительность рамки отрегулирована на обнаружение только очень массивных металлических предметов).

Слово «отрицательный» в данном случае не имеет отношения к желательности или нежелательности самого события.

Термин широко используется в медицине. Например, тесты, предназначенные для диагностики заболеваний, иногда дают отрицательный результат (т.е. показывают отсутствие заболевания у пациента), когда на самом деле пациент страдает этим заболеванием. Такой результат называется ложноотрицательным.

В других областях обычно используют словосочетания со схожим смыслом, например, «пропуск события», и т.п. В информационных технологиях часто используют английский термин false negative без перевода.

Степень чувствительности системы защиты должна представлять собой компромисс между вероятностью ошибок первого и второго рода. Где именно находится точка баланса, зависит от оценки рисков обоих видов ошибок.

Вероятности ошибок (уровень значимости и мощность)[править | править исходный текст]

Вероятность ошибки первого рода при проверке статистических гипотез называют уровнем значимости и обычно обозначают греческой буквой

Вероятность ошибки второго рода не имеет какого-то особого общепринятого названия, на письме обозначается греческой буквой

Обе эти характеристики обычно вычисляются с помощью так называемой функции мощности критерия. В частности, вероятность ошибки первого рода есть функция мощности, вычисленная при нулевой гипотезе. Для критериев, основанных на выборке фиксированного объема, вероятность ошибки второго рода есть единица минус функция мощности, вычисленная в предположении, что распределение наблюдений соответствует альтернативной гипотезе. Для последовательных критериев это также верно, если критерий останавливается с вероятностью единица (при данном распределении из альтернативы).

В статистических тестах обычно приходится идти на компромисс между приемлемым уровнем ошибок первого и второго рода. Зачастую для принятия решения используется пороговое значение, которое может варьироваться с целью сделать тест более строгим или, наоборот, более мягким. Этим пороговым значением является уровень значимости, которым задаются при проверке статистических гипотез. Например, в случае металлодетектора повышение чувствительности прибора приведёт к увеличению риска ошибки первого рода (ложная тревога), а понижение чувствительности — к увеличению риска ошибки второго рода (пропуск запрещённого предмета).

Примеры использования[править | править исходный текст]

Радиолокация[править | править исходный текст]

В задаче радиолокационного обнаружения воздушных целей, прежде всего, в системе ПВО ошибки первого и второго рода, с формулировкой «пропуск цели» и «ложная тревога» являются одним из основных элементов как теории, так и практики построения радиолокационных станций. Вероятно, это первый пример последовательного применения статистических методов в целой технической области.

Компьютеры[править | править исходный текст]

Понятия ошибок первого и второго рода широко используются в области компьютеров и программного обеспечения.

Компьютерная безопасность[править | править исходный текст]

Наличие уязвимостей в вычислительных системах приводит к тому, что приходится, с одной стороны, решать задачу сохранения целостности компьютерных данных, а с другой стороны — обеспечивать нормальный доступ легальных пользователей к этим данным (см. компьютерная безопасность). Moulton (1983, с.125) отмечает, что в данном контексте возможны следующие нежелательные ситуации:

- когда авторизованные пользователи классифицируются как нарушители (ошибки первого рода)

- когда нарушители классифицируются как авторизованные пользователи (ошибки второго рода)

Фильтрация спама[править | править исходный текст]

Ошибка первого рода происходит, когда механизм блокировки/фильтрации спама ошибочно классифицирует легитимное email-сообщение как спам и препятствует его нормальной доставке. В то время как большинство «антиспам»-алгоритмов способны блокировать/фильтровать большой процент нежелательных email-сообщений, гораздо более важной задачей является минимизировать число «ложных тревог» (ошибочных блокировок нужных сообщений).

Ошибка второго рода происходит, когда антиспам-система ошибочно пропускает нежелательное сообщение, классифицируя его как «не спам». Низкий уровень таких ошибок является индикатором эффективности антиспам-алгоритма.

Пока не удалось создать антиспамовую систему без корреляции между вероятностью ошибок первого и второго рода. Вероятность пропустить спам у современных систем колеблется в пределах от 1% до 30%. Вероятность ошибочно отвергнуть валидное сообщение — от 0,001 % до 3 %. Выбор системы и её настроек зависит от условий конкретного получателя: для одних получателей риск потерять 1% хорошей почты оценивается как незначительный, для других же потеря даже 0,1% является недопустимой.

Вредоносное программное обеспечение[править | править исходный текст]

Понятие ошибки первого рода также используется, когда антивирусное программное обеспечение ошибочно классифицирует безвредный файл как вирус. Неверное обнаружение может быть вызвано особенностями эвристики, либо неправильной сигнатурой вируса в базе данных. Подобные проблемы могут происходить также и с антитроянскими и антишпионскими программами.

Поиск в компьютерных базах данных[править | править исходный текст]

При поиске в базе данных к ошибкам второго рода можно отнести документы, которые выдаются поиском, несмотря на их иррелевантность (несоответствие) поисковому запросу. Ошибочные срабатывания характерны для полнотекстового поиска, когда поисковый алгоритм анализирует полные тексты всех хранимых в базе данных документов и пытается найти соответствия одному или нескольким терминам, заданным пользователем в запросе.

Большинство ложных срабатываний обусловлены сложностью естественных языков, многозначностью слов: например, «home» может обозначать как «место проживания человека», так и «корневую страницу веб-сайта». Число подобных ошибок может быть снижено за счёт использования специального словаря. Однако это решение относительно дорогое, поскольку подобный словарь и разметка документов (индексирование) должны создаваться экспертом.

Оптическое распознавание текстов (OCR)[править | править исходный текст]

Разнообразные детектирующие алгоритмы нередко выдают ошибки первого рода. Программное обеспечение оптического распознавания текстов может распознать букву «a» в ситуации, когда на самом деле изображены несколько точек, которые используемый алгоритм расценил как «a».

Досмотр пассажиров и багажа[править | править исходный текст]

Ошибки первого рода регулярно встречаются каждый день в компьютерных системах предварительного досмотра пассажиров в аэропортах. Установленные в них детекторы предназначены для предотвращения проноса оружия на борт самолёта; тем не менее, уровень чувствительности в них зачастую настраивается настолько высоко, что много раз за день они срабатывают на незначительные предметы, такие как ключи, пряжки ремней, монеты, мобильные телефоны, гвозди в подошвах обуви и т.п. (см. обнаружение взрывчатых веществ, металлодетекторы).

Таким образом, соотношение числа ложных тревог (идентифицикация благопристойного пассажира как правонарушителя) к числу правильных срабатываний (обнаружение действительно запрещённых предметов) очень велико.

Биометрия[править | править исходный текст]

Ошибки первого и второго рода являются большой проблемой в системах биометрического сканирования, использующих распознавание радужной оболочки или сетчатки глаза, черт лица и т.д. Такие сканирующие системы могут ошибочно отождествить кого-то с другим, «известным» системе человеком, информация о котором хранится в базе данных (к примеру, это может быть лицо, имеющее право входа в систему, или подозреваемый преступник и т.п.). Противоположной ошибкой будет неспособность системы распознать легитимного зарегистрированного пользователя, или опознать подозреваемого в преступлении.[3]

Массовая медицинская диагностика (скрининг)[править | править исходный текст]

В медицинской практике есть существенное различие между скринингом и тестированием:

- Скрининг включает в себя относительно дешёвые тесты, которые проводятся для большой группы людей при отсутствии каких-либо клинических признаков болезни (например, мазок Папаниколау).

- Тестирование подразумевает гораздо более дорогие, зачастую инвазивные, процедуры, которые проводятся только для тех, у кого проявляются клинические признаки заболевания, и которые, в основном, применяются для подтверждения предполагаемого диагноза.

К примеру, в большинстве штатов в США обязательно прохождение новорожденными процедуры скрининга на оксифенилкетонурию и гипотиреоз, помимо других врождённых аномалий. Несмотря на высокий уровень ошибок первого рода, эти процедуры скрининга считаются целесообразными, поскольку они существенно увеличивают вероятность обнаружения этих расстройств на самой ранней стадии.[4]

Простые анализы крови, используемые для скрининга потенциальных доноров на ВИЧ и гепатит, имеют существенный уровень ошибок первого рода; однако в арсенале врачей есть гораздо более точные (и, соответственно, дорогие) тесты для проверки, действительно ли человек инфицирован каким-либо из этих вирусов.

Возможно, наиболее широкие дискуссии вызывают ошибки первого рода в процедурах скрининга на рак груди (маммография). В США уровень ошибок первого рода в маммограммах достигает 15%, это самый высокий показатель в мире.[5] Самый низкий уровень наблюдается в Нидерландах, 1%.[6]

Медицинское тестирование[править | править исходный текст]

Ошибки второго рода являются существенной проблемой в медицинском тестировании. Они дают пациенту и врачу ложное убеждение, что заболевание отсутствует, в то время как в действительности оно есть. Это зачастую приводит к неуместному или неадекватному лечению. Типичным примером является доверие результатам кардиотестирования при выявлении коронарного атеросклероза, хотя известно, что кардиотестирование выявляет только те затруднения кровотока в коронарной артерии, которые вызваны стенозом.

Ошибки второго рода вызывают серьёзные и трудные для понимания проблемы, особенно когда искомое условие является широкораспространённым. Если тест с 10%-ным уровнем ошибок второго рода используется для обследования группы, где вероятность «истинно-положительных» случаев составляет 70%, то многие отрицательные результаты теста окажутся ложными. (См. Теорему Байеса).

Ошибки первого рода также могут вызывать серьёзные и трудные для понимания проблемы. Это происходит, когда искомое условие является редким. Если уровень ошибок первого рода у теста составляет один случай на десять тысяч, но в тестируемой группе образцов (или людей) вероятность «истинно-положительных» случаев составляет в среднем один случай на миллион, то большинство положительных результатов этого теста будут ложными.[7]

Исследования сверхъестественных явлений[править | править исходный текст]

Термин ошибка первого рода был взят на вооружение исследователями в области паранормальных явлений и привидений для описания фотографии или записи или какого-либо другого свидетельства, которое ошибочно трактуется как имеющее паранормальное происхождение — в данном контексте ошибка первого рода — это какое-либо несостоятельное «медиасвидетельство» (изображение, видеозапись, аудиозапись и т.д.), которое имеет обычное объяснение.[8]

См. также[править | править исходный текст]

- Статистическая значимость

- Атака второго рода

- Случаи ложного срабатывания систем предупреждения о ракетном нападении

- Receiver_operating_characteristic

Примечания[править | править исходный текст]

- ↑ ГОСТ Р 50779.10-2000. «Статистические методы. Вероятность и основы статистики. Термины и определения.». Стр. 26

- ↑ Valerie J. Easton, John H. McColl. Statistics Glossary: Hypothesis Testing.

- ↑ Данный пример как раз характеризует случай, когда классификация ошибок будет зависеть от назначения системы: если биометрическое сканирование используется для допуска сотрудников (нулевая гипотеза: «проходящий сканирование человек действительно является сотрудником»), то ошибочное отождествление будет ошибкой второго рода, а «неузнавание» — ошибкой первого рода; если же сканирование используется для опознания преступников (нулевая гипотеза: «проходящий сканирование человек не является преступником»), то ошибочное отождествление будет ошибкой первого рода, а «неузнавание» — ошибкой второго рода.

- ↑ Относительно скрининга новорожденных, последние исследования показали, что количество ошибок первого рода в 12 раз больше, чем количество верных обнаружений (Gambrill, 2006. [1])

- ↑ Одним из последствий такого высокого уровня ошибок первого рода в США является то, что за произвольный 10-летний период половина обследуемых американских женщин получают как минимум одну ложноположительную маммограмму. Такие ошибочные маммограммы обходятся дорого, приводя к ежегодным расходам в 100 миллионов долларов на последующее (ненужное) лечение. Кроме того, они вызывают излишнюю тревогу у женщин. В результате высокого уровня подобных ошибок первого рода в США, примерно у 90-95% женщин, получивших хотя бы раз в жизни положительную маммограмму, на самом деле заболевание отсутствует.

- ↑ Наиболее низкие уровни этих ошибок наблюдаются в северной Европе, где маммографические плёнки считываются дважды, и для дополнительного тестирования устанавливается повышенное пороговое значение (высокий порог снижает статистическую эффективность теста).

- ↑ Вероятность того, что выдаваемый тестом результат окажется ошибкой первого рода, может быть вычислена при помощи Теоремы Байеса.

- ↑ На некоторых сайтах приведены примеры ошибок первого рода, например: Атлантическое Сообщество Паранормальных явлений (The Atlantic Paranormal Society, TAPS) (недоступная ссылка с 13-05-2013 (398 дней)) и Морстаунская организация по Исследованию Привидений (Moorestown Ghost Research) (недоступная ссылка с 13-05-2013 (398 дней) — история).

Ошибка первого рода в статистике – это ошибка, которая происходит, когда мы отвергаем нулевую гипотезу, хотя она на самом деле верна.

О чем статья

Введение

Добро пожаловать на лекцию по теории вероятности! Сегодня мы будем говорить о важном понятии – ошибке первого рода. Ошибка первого рода является одной из основных ошибок, которые могут возникнуть при проведении статистического исследования или эксперимента. В этой лекции мы рассмотрим определение ошибки первого рода, приведем примеры и обсудим свойства этой ошибки. Также мы обсудим, как можно минимизировать ошибку первого рода и какое значение она имеет в статистике. Давайте начнем!

Нужна помощь в написании работы?

Мы — биржа профессиональных авторов (преподавателей и доцентов вузов). Наша система гарантирует сдачу работы к сроку без плагиата. Правки вносим бесплатно.

Заказать работу

Определение ошибки первого рода

Ошибкой первого рода в теории вероятности называется ситуация, когда нулевая гипотеза отвергается, хотя она на самом деле верна. То есть, это ошибка, которая происходит, когда мы делаем неверный вывод о наличии эффекта или различии между группами на основе имеющихся данных.

Для лучшего понимания, давайте рассмотрим пример. Предположим, у нас есть новый лекарственный препарат, который, по заявлению производителя, эффективно лечит определенное заболевание. Нулевая гипотеза в данном случае будет звучать так: “Этот препарат не имеет эффекта на лечение заболевания”.

Для проверки этой гипотезы, мы проводим исследование, где случайным образом выбираем группу пациентов, которым дают этот препарат, и контрольную группу, которой дают плацебо. После определенного периода времени, мы анализируем результаты и делаем статистический вывод.

Если мы отвергаем нулевую гипотезу и делаем вывод, что препарат действительно эффективен, но на самом деле это не так, то это будет ошибкой первого рода. То есть, мы сделали неверный вывод о наличии эффекта, хотя на самом деле его нет.

Примеры ошибки первого рода

Ошибку первого рода можно проиллюстрировать на примере медицинских исследований. Предположим, у нас есть новый препарат, который, по предварительным данным, может лечить определенное заболевание. Мы проводим клиническое исследование, в котором случайным образом выбираем группу пациентов, которым дают этот препарат, и контрольную группу, которой дают плацебо. После определенного периода времени, мы анализируем результаты и делаем статистический вывод.

Если мы отвергаем нулевую гипотезу и делаем вывод, что препарат действительно эффективен, но на самом деле это не так, то это будет ошибкой первого рода. То есть, мы сделали неверный вывод о наличии эффекта, хотя на самом деле его нет.

Например, предположим, что уровень значимости, который мы выбрали для нашего исследования, составляет 0,05. Это означает, что мы готовы принять ошибку первого рода с вероятностью 5%. Если на самом деле препарат не имеет эффекта, то с вероятностью 5% мы все равно можем получить статистически значимые результаты и сделать неверный вывод о его эффективности.

Таким образом, ошибку первого рода можно рассматривать как ложное положительное срабатывание, когда мы ошибочно считаем, что есть эффект, хотя его на самом деле нет.

Свойства ошибки первого рода

Ошибку первого рода также называют ложным положительным результатом или ложным срабатыванием. Она имеет несколько свойств, которые важно учитывать при проведении статистических исследований:

Вероятность ошибки первого рода

Вероятность ошибки первого рода обозначается символом α (альфа) и представляет собой вероятность получить статистически значимый результат, когда на самом деле нет никакого эффекта или различия между группами. Обычно устанавливается заранее и может быть выбрана исследователем в зависимости от требуемого уровня достоверности.

Уровень значимости

Уровень значимости (α) является мерой вероятности ошибки первого рода. Обычно выбирается заранее и определяет, какую вероятность ошибки первого рода мы готовы принять. Наиболее распространенным уровнем значимости является 0,05 или 5%, что означает, что мы готовы принять ошибку первого рода с вероятностью 5%.

Влияние размера выборки

Размер выборки может влиять на вероятность ошибки первого рода. Чем больше выборка, тем меньше вероятность ошибки первого рода. Это связано с тем, что больший объем данных обычно дает более точные и надежные результаты, что уменьшает вероятность случайных ложных срабатываний.

Взаимосвязь с ошибкой второго рода

Ошибки первого и второго рода взаимосвязаны. Уменьшение вероятности ошибки первого рода может привести к увеличению вероятности ошибки второго рода и наоборот. Это связано с тем, что при установлении более строгих критериев для отвержения нулевой гипотезы (уменьшение α) мы можем пропустить настоящий эффект (ошибка второго рода).

Важно учитывать свойства ошибки первого рода при проведении статистических исследований, чтобы сделать правильные выводы и избежать неправильных интерпретаций результатов.

Как минимизировать ошибку первого рода

Ошибку первого рода можно минимизировать, применяя следующие подходы:

Установление адекватного уровня значимости

Уровень значимости (обозначается как α) определяет, насколько мы готовы принять ошибку первого рода. Чем меньше значение α, тем меньше вероятность ошибки первого рода. Однако, необходимо учитывать, что слишком низкий уровень значимости может привести к увеличению ошибки второго рода. Поэтому выбор уровня значимости должен быть обоснованным и основываться на конкретных требованиях исследования.

Использование большего объема выборки

Увеличение объема выборки позволяет уменьшить вероятность ошибки первого рода. Больший объем выборки обеспечивает более точные и надежные результаты исследования. Однако, необходимо учитывать, что увеличение объема выборки может быть связано с дополнительными затратами времени и ресурсов.

Проведение повторных экспериментов

Проведение повторных экспериментов позволяет убедиться в достоверности полученных результатов и уменьшить вероятность ошибки первого рода. Повторные эксперименты могут быть полезными, особенно в случаях, когда результаты исследования имеют важное практическое значение или когда результаты первоначального исследования вызывают сомнения.

Контроль качества данных и анализа

Контроль качества данных и анализа является важным шагом для минимизации ошибки первого рода. Это включает проверку данных на наличие ошибок, выбросов и пропусков, а также проверку корректности применяемых статистических методов и моделей. Корректный и точный анализ данных помогает избежать неправильных выводов и ошибок в интерпретации результатов.

В целом, минимизация ошибки первого рода требует внимательного и осознанного подхода к проведению статистических исследований. Необходимо учитывать контекст и цели исследования, а также применять соответствующие методы и подходы для достижения надежных и точных результатов.

Значение ошибки первого рода в статистике

Ошибки первого рода являются важным понятием в статистике и имеют большое значение при проведении статистических тестов и исследований. Ошибка первого рода возникает, когда нулевая гипотеза отвергается, хотя она на самом деле верна.

В статистике мы часто сталкиваемся с задачей проверки гипотезы. Гипотеза – это утверждение о параметрах или свойствах генеральной совокупности. Нулевая гипотеза (H0) предполагает, что никаких различий или эффектов нет, альтернативная гипотеза (H1) предполагает наличие различий или эффектов.

При проведении статистического теста мы принимаем решение о том, отвергать или не отвергать нулевую гипотезу, основываясь на полученных данных и уровне значимости. Уровень значимости (обычно обозначается как α) определяет вероятность совершения ошибки первого рода.

Если мы устанавливаем уровень значимости на 0.05 (или 5%), это означает, что мы готовы принять решение об отвержении нулевой гипотезы, если вероятность получить такие или более экстремальные результаты при условии, что нулевая гипотеза верна, составляет менее 5%.

Ошибки первого рода имеют свои последствия. Если мы совершаем ошибку первого рода и отвергаем нулевую гипотезу, когда она на самом деле верна, мы делаем неправильные выводы и принимаем неверные решения. Это может привести к неправильным рекомендациям или действиям на основе неверных данных.

Поэтому важно тщательно выбирать уровень значимости и проводить статистические тесты с учетом возможности ошибки первого рода. Также следует помнить, что уровень значимости и вероятность ошибки первого рода тесно связаны с мощностью теста и вероятностью ошибки второго рода.

Таблица сравнения ошибки первого рода и ошибки второго рода

| Тип ошибки | Описание | Пример |

|---|---|---|

| Ошибка первого рода | Отклонение от нулевой гипотезы, когда она на самом деле верна | Отклонение невиновного человека в суде |

| Ошибка второго рода | Неотклонение от нулевой гипотезы, когда она на самом деле ложна | Пропуск виновного человека в суде |

Заключение

Ошибки первого рода являются важным понятием в теории вероятности и статистике. Они возникают, когда мы отвергаем нулевую гипотезу, хотя она на самом деле верна. Это может привести к неправильным выводам и ошибочным решениям. Чтобы минимизировать ошибку первого рода, необходимо выбирать уровень значимости и критическую область с учетом конкретной задачи и требований исследования. Важно помнить, что ошибки первого рода нельзя полностью исключить, но их вероятность можно уменьшить путем правильного выбора статистических методов и анализа данных.

,

, соответствует гипотезе

соответствует гипотезе  .

. .

.