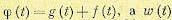

При использовании

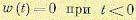

критерия минимума СКО, взвешивающие коэффициенты ячеек эквалайзера подстраиваются

так, чтобы минимизировать средний квадрат ошибки

, (10.2.24)

где — информационный символ,

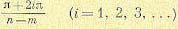

переданный на -ом

сигнальном интервале, a — оценка этого символа на выходе

эквалайзера, определяемая (10.2.1). Если информационные символы комплексные, то

показатель качества при СКО критерия, обозначаемый , определяется так

. (10.2.25)

С другой стороны, когда

информационные символы вещественные, показатель качества просто равен квадрату

вещественной величины . В любом случае,

является квадратичнйй

функцией коэффициентов эквалайзера . При дальнейшем обсуждении мы

рассмотрим минимизацию комплексной формы, даваемой (10.2.25).

Эквалайзер неограниченной

длины. Сначала

определим взвешивающие коэффициенты ячеек, которые минимизируют , когда эквалайзер

имеет неограниченное число ячеек. В этом случае, оценка определяется так

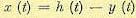

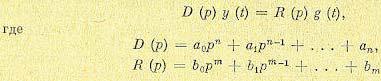

Подстановка (10.2.26) в

выражение для ,

определяемая (10.2.25), и расширение результата приводит к квадратичной функции

от коэффициентов .

Эту функцию можно легко минимизировать по посредством решения системы

(неограниченной) линейных уравнений для . Альтернативно, систему линейных

уравнений можно получить путём использования принципа ортогональности при

среднеквадратичном оценивании. Это значит, мы выбираем коэффициенты такие, что ошибка

ортогональна

сигнальной

последовательности для

. То есть

(10.2.27)

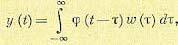

Подстановка в (10.2.27) даёт

или, что эквивалентно,

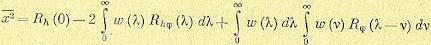

Чтобы вычислить моменты в

(10.2.28), мы используем выражение для даваемое (10.1.16). Таким образом,

получим

и

Теперь, если подставим

(10.2.29) и (10.2.30) в (10.2.28) и возьмём -преобразование от обеих частей

результирующего уравнения, мы находим

. (10.2.31)

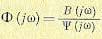

Следовательно,

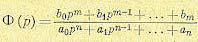

передаточная функция эквалайзера, основанного на критерии минимума СКО, равна

Если обеляющий фильтр

включён в ,

мы получаем эквивалентный эквалайзер с передаточной функцией

Видим, что единственная

разница между этим выражением для и тем, которое базируется на критерии

пикового искажения — это спектральная плотность шума , которая появилась в (10.2.33),

Если очень

мало по сравнению с сигналом, коэффициенты, которые минимизируют пиковые

искажения приближённо

равны коэффициентам, которые минимизируют по СКО показатель качества . Это значит, что в

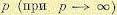

пределе, когда ,

два критерия дают одинаковое решение для взвешивающих коэффициентов. Следовательно,

когда , минимизация

СКО ведёт к полному исключению МСИ. С другой стороны, это не так, когда . В общем, когда

, оба критерия дают

остаточное МСИ и аддитивный шум на выходе эквалайзера.

Меру остаточного МСИ и

аддитивного шума на выходе эквалайзера можно получить расчётом минимальной

величины ,

обозначаемую ,

когда передаточная функция

эквалайзера определена

(10.2.32). Поскольку и поскольку

с учётом условия

ортогональности (10.2.27), следует

Эта частная форма для не очень

информативна. Больше понимания зависимости качества эквалайзера от канальных

характеристик можно получить, если суммы в (10.2.34) преобразовать в частотную

область. Это можно выполнить, заметив, что сумма в (10.2.34) является свёрткой и

, вычисленной при

нулевом сдвиге. Так, если через обозначить свёртку этих

последовательностей, то сумма в (10.2.34) просто равна . Поскольку

— преобразование

последовательности равно

то слагаемое равно

Контурный интеграл в

(10.2.36) можно преобразовать в эквивалентный линейный интеграл путём замены

переменной .

В результате этой замены получаем

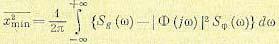

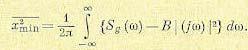

Наконец, подставив (10.2.37)

в сумму (10.2.34), получаем желательное выражение для минимума СКО в виде

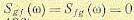

В отсутствие МСИ и, следовательно,

. (10.2.39)

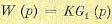

Видим, что . Далее,

соотношение между выходным (нормированного по энергии сигнала) ОСШ и

выглядит так

.

Более

существенно то, что соотношение и

также имеет силу, когда имеется

остаточная МСИ в дополнении к шуму на выходе эквалайзера.

Эквалайзер ограниченной длины. Теперь

вернём наше внимание к случаю, когда длительность импульсной характеристики

трансверсального эквалайзера простирается на ограниченном временном интервале,

т.е. эквалайзер имеет конечную память или ограниченную длину. Выход эквалайзера

на -м сигнальном

интервале равен

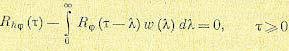

СКО эквалайзера с ячейками, обозначаемый

, равен

Минимизация по взвешивающим

коэффициентам ячеек или, что эквивалентно, требуя, чтобы

ошибка была

бы ортогональна сигнальным отсчётам ,

, приводит к следующей системе

уравнений:

где

Удобно

выразить систему линейных уравнений в матричной форме, т.е.

где означает вектор столбец

взвешивающих

значений кодовых ячеек, означает

матрицу ковариаций Эрмита с

элементами ;

а мерный

вектор столбец с элементами . Решение (10.2.46) можно записать в

виде

Таким образом, решение для включает в себя

обращение матрицы . Оптимальные взвешивающие

коэффициенты ячеек, даваемые (10.2.47), минимизируют показатель качества , что приводит к

минимальной величине

где определяет транспонированный вектор

столбец .

можно

использовать в (10.2.40) для вычисления ОСШ линейного эквивалента с коэффициентами

ячеек.

При использовании

критерия минимума СКО, взвешивающие коэффициенты ячеек эквалайзера подстраиваются

так, чтобы минимизировать средний квадрат ошибки

, (10.2.24)

где — информационный символ,

переданный на -ом

сигнальном интервале, a — оценка этого символа на выходе

эквалайзера, определяемая (10.2.1). Если информационные символы комплексные, то

показатель качества при СКО критерия, обозначаемый , определяется так

. (10.2.25)

С другой стороны, когда

информационные символы вещественные, показатель качества просто равен квадрату

вещественной величины . В любом случае,

является квадратичнйй

функцией коэффициентов эквалайзера . При дальнейшем обсуждении мы

рассмотрим минимизацию комплексной формы, даваемой (10.2.25).

Эквалайзер неограниченной

длины. Сначала

определим взвешивающие коэффициенты ячеек, которые минимизируют , когда эквалайзер

имеет неограниченное число ячеек. В этом случае, оценка определяется так

Подстановка (10.2.26) в

выражение для ,

определяемая (10.2.25), и расширение результата приводит к квадратичной функции

от коэффициентов .

Эту функцию можно легко минимизировать по посредством решения системы

(неограниченной) линейных уравнений для . Альтернативно, систему линейных

уравнений можно получить путём использования принципа ортогональности при

среднеквадратичном оценивании. Это значит, мы выбираем коэффициенты такие, что ошибка

ортогональна

сигнальной

последовательности для

. То есть

(10.2.27)

Подстановка в (10.2.27) даёт

или, что эквивалентно,

Чтобы вычислить моменты в

(10.2.28), мы используем выражение для даваемое (10.1.16). Таким образом,

получим

и

Теперь, если подставим

(10.2.29) и (10.2.30) в (10.2.28) и возьмём -преобразование от обеих частей

результирующего уравнения, мы находим

. (10.2.31)

Следовательно,

передаточная функция эквалайзера, основанного на критерии минимума СКО, равна

Если обеляющий фильтр

включён в ,

мы получаем эквивалентный эквалайзер с передаточной функцией

Видим, что единственная

разница между этим выражением для и тем, которое базируется на критерии

пикового искажения — это спектральная плотность шума , которая появилась в (10.2.33),

Если очень

мало по сравнению с сигналом, коэффициенты, которые минимизируют пиковые

искажения приближённо

равны коэффициентам, которые минимизируют по СКО показатель качества . Это значит, что в

пределе, когда ,

два критерия дают одинаковое решение для взвешивающих коэффициентов. Следовательно,

когда , минимизация

СКО ведёт к полному исключению МСИ. С другой стороны, это не так, когда . В общем, когда

, оба критерия дают

остаточное МСИ и аддитивный шум на выходе эквалайзера.

Меру остаточного МСИ и

аддитивного шума на выходе эквалайзера можно получить расчётом минимальной

величины ,

обозначаемую ,

когда передаточная функция

эквалайзера определена

(10.2.32). Поскольку и поскольку

с учётом условия

ортогональности (10.2.27), следует

Эта частная форма для не очень

информативна. Больше понимания зависимости качества эквалайзера от канальных

характеристик можно получить, если суммы в (10.2.34) преобразовать в частотную

область. Это можно выполнить, заметив, что сумма в (10.2.34) является свёрткой и

, вычисленной при

нулевом сдвиге. Так, если через обозначить свёртку этих

последовательностей, то сумма в (10.2.34) просто равна . Поскольку

— преобразование

последовательности равно

то слагаемое равно

Контурный интеграл в

(10.2.36) можно преобразовать в эквивалентный линейный интеграл путём замены

переменной .

В результате этой замены получаем

Наконец, подставив (10.2.37)

в сумму (10.2.34), получаем желательное выражение для минимума СКО в виде

В отсутствие МСИ и, следовательно,

. (10.2.39)

Видим, что . Далее,

соотношение между выходным (нормированного по энергии сигнала) ОСШ и

выглядит так

.

Более

существенно то, что соотношение и

также имеет силу, когда имеется

остаточная МСИ в дополнении к шуму на выходе эквалайзера.

Эквалайзер ограниченной длины. Теперь

вернём наше внимание к случаю, когда длительность импульсной характеристики

трансверсального эквалайзера простирается на ограниченном временном интервале,

т.е. эквалайзер имеет конечную память или ограниченную длину. Выход эквалайзера

на -м сигнальном

интервале равен

СКО эквалайзера с ячейками, обозначаемый

, равен

Минимизация по взвешивающим

коэффициентам ячеек или, что эквивалентно, требуя, чтобы

ошибка была

бы ортогональна сигнальным отсчётам ,

, приводит к следующей системе

уравнений:

где

Удобно

выразить систему линейных уравнений в матричной форме, т.е.

где означает вектор столбец

взвешивающих

значений кодовых ячеек, означает

матрицу ковариаций Эрмита с

элементами ;

а мерный

вектор столбец с элементами . Решение (10.2.46) можно записать в

виде

Таким образом, решение для включает в себя

обращение матрицы . Оптимальные взвешивающие

коэффициенты ячеек, даваемые (10.2.47), минимизируют показатель качества , что приводит к

минимальной величине

где определяет транспонированный вектор

столбец .

можно

использовать в (10.2.40) для вычисления ОСШ линейного эквивалента с коэффициентами

ячеек.

In statistics and signal processing, a minimum mean square error (MMSE) estimator is an estimation method which minimizes the mean square error (MSE), which is a common measure of estimator quality, of the fitted values of a dependent variable. In the Bayesian setting, the term MMSE more specifically refers to estimation with quadratic loss function. In such case, the MMSE estimator is given by the posterior mean of the parameter to be estimated. Since the posterior mean is cumbersome to calculate, the form of the MMSE estimator is usually constrained to be within a certain class of functions. Linear MMSE estimators are a popular choice since they are easy to use, easy to calculate, and very versatile. It has given rise to many popular estimators such as the Wiener–Kolmogorov filter and Kalman filter.

Motivation[edit]

The term MMSE more specifically refers to estimation in a Bayesian setting with quadratic cost function. The basic idea behind the Bayesian approach to estimation stems from practical situations where we often have some prior information about the parameter to be estimated. For instance, we may have prior information about the range that the parameter can assume; or we may have an old estimate of the parameter that we want to modify when a new observation is made available; or the statistics of an actual random signal such as speech. This is in contrast to the non-Bayesian approach like minimum-variance unbiased estimator (MVUE) where absolutely nothing is assumed to be known about the parameter in advance and which does not account for such situations. In the Bayesian approach, such prior information is captured by the prior probability density function of the parameters; and based directly on Bayes theorem, it allows us to make better posterior estimates as more observations become available. Thus unlike non-Bayesian approach where parameters of interest are assumed to be deterministic, but unknown constants, the Bayesian estimator seeks to estimate a parameter that is itself a random variable. Furthermore, Bayesian estimation can also deal with situations where the sequence of observations are not necessarily independent. Thus Bayesian estimation provides yet another alternative to the MVUE. This is useful when the MVUE does not exist or cannot be found.

Definition[edit]

Let

where the expectation

The MMSE estimator is then defined as the estimator achieving minimal MSE:

Properties[edit]

- When the means and variances are finite, the MMSE estimator is uniquely defined[1] and is given by:

-

- In other words, the MMSE estimator is the conditional expectation of

given the known observed value of the measurements. Also, since

is the posterior mean, the error covariance matrix

is equal to the posterior covariance

matrix,

.

- The MMSE estimator is unbiased (under the regularity assumptions mentioned above):

- The MMSE estimator is asymptotically unbiased and it converges in distribution to the normal distribution:

-

- where

is the Fisher information of

. Thus, the MMSE estimator is asymptotically efficient.

-

- for all

in closed, linear subspace

of the measurements. For random vectors, since the MSE for estimation of a random vector is the sum of the MSEs of the coordinates, finding the MMSE estimator of a random vector decomposes into finding the MMSE estimators of the coordinates of X separately:

- for all i and j. More succinctly put, the cross-correlation between the minimum estimation error

and the estimator

should be zero,

Linear MMSE estimator[edit]

In many cases, it is not possible to determine the analytical expression of the MMSE estimator. Two basic numerical approaches to obtain the MMSE estimate depends on either finding the conditional expectation

One possibility is to abandon the full optimality requirements and seek a technique minimizing the MSE within a particular class of estimators, such as the class of linear estimators. Thus, we postulate that the conditional expectation of

One advantage of such linear MMSE estimator is that it is not necessary to explicitly calculate the posterior probability density function of

The expression for optimal

where

Thus, the expression for linear MMSE estimator, its mean, and its auto-covariance is given by

where the

Lastly, the error covariance and minimum mean square error achievable by such estimator is

Univariate case[edit]

For the special case when both

where

The above two equations allows us to interpret the correlation coefficient either as normalized slope of linear regression

or as square root of the ratio of two variances

.

When

Computation[edit]

Standard method like Gauss elimination can be used to solve the matrix equation for

Linear MMSE estimator for linear observation process[edit]

Let us further model the underlying process of observation as a linear process:

Thus the expression for the linear MMSE estimator matrix

Putting everything into the expression for

Lastly, the error covariance is

The significant difference between the estimation problem treated above and those of least squares and Gauss–Markov estimate is that the number of observations m, (i.e. the dimension of

Alternative form[edit]

An alternative form of expression can be obtained by using the matrix identity

which can be established by post-multiplying by

and

Since

In this form the above expression can be easily compared with weighed least square and Gauss–Markov estimate. In particular, when

Sequential linear MMSE estimation[edit]

In many real-time applications, observational data is not available in a single batch. Instead the observations are made in a sequence. One possible approach is to use the sequential observations to update an old estimate as additional data becomes available, leading to finer estimates. One crucial difference between batch estimation and sequential estimation is that sequential estimation requires an additional Markov assumption.

In the Bayesian framework, such recursive estimation is easily facilitated using Bayes’ rule. Given

The

This is the Markov assumption.

The MMSE estimate

In the context of linear MMSE estimator, the formula for the estimate will have the same form as before. However, the mean and covariance matrices of

The mean and covariance matrix of the prior density

respectively, as per by the property of MMSE estimators.

Similarly, for the linear observation process, the mean and covariance matrix of the likelihood

.

The difference between the predicted value of

![{displaystyle mathrm {E} [{tilde {y}}_{k}]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7333e06de208be900c7d618273db57bf678fb1f)

.

Hence, in the estimate update formula, we should replace

Thus, we have the new estimate as

and the new error covariance as

From the point of view of linear algebra, for sequential estimation, if we have an estimate

The repeated use of the above two equations as more observations become available lead to recursive estimation techniques. The expressions can be more compactly written as

The matrix

The repetition of these three steps as more data becomes available leads to an iterative estimation algorithm. The generalization of this idea to non-stationary cases gives rise to the Kalman filter. The three update steps outlined above indeed form the update step of the Kalman filter.

Special case: scalar observations[edit]

As an important special case, an easy to use recursive expression can be derived when at each k-th time instant the underlying linear observation process yields a scalar such that

where

The

Here, no matrix inversion is required. Also, the gain factor,

Alternative approaches: This important special case has also given rise to many other iterative methods (or adaptive filters), such as the least mean squares filter and recursive least squares filter, that directly solves the original MSE optimization problem using stochastic gradient descents. However, since the estimation error

where

Examples[edit]

Example 1[edit]

We shall take a linear prediction problem as an example. Let a linear combination of observed scalar random variables

![{displaystyle z=[z_{1},z_{2},z_{3},z_{4}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/45cb1f9123fdf786074088616e42dfbcc1359d07)

then our task is to find the coefficients

In terms of the terminology developed in the previous sections, for this problem we have the observation vector ![{displaystyle y=[z_{1},z_{2},z_{3}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7fdeb8eb600c7a066561d28e2b3f32fb5b1572b9)

![W=[w_{1},w_{2},w_{3}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd8e9343b228a9044dbb8208e9ceeb31270b04c1)

The cross correlation matrix

We now solve the equation

So we have

as the optimal coefficients for

mean square error then gives ![{displaystyle leftVert erightVert _{min }^{2}=operatorname {E} [z_{4}z_{4}]-WC_{YX}=15-WC_{YX}=.2857}](https://wikimedia.org/api/rest_v1/media/math/render/svg/44558ab7a0b5ead1b9571853096d800773b38877)

Example 2[edit]

Consider a vector

![1=[1,1,ldots ,1]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/43fec89f837a5e8d53869fb49ec95a9e56a788f0)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

Thus, the linear MMSE estimator is given by

We can simplify the expression by using the alternative form for

where for ![y=[y_{1},y_{2},ldots ,y_{N}]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8317c7045e5b1318cec0c4ee89727a02cdeecafc)

Similarly, the variance of the estimator is

Thus the MMSE of this linear estimator is

For very large

while the variance will be unaffected by data

However, the estimator is suboptimal since it is constrained to be linear. Had the random variable

Example 3[edit]

Consider a variation of the above example: Two candidates are standing for an election. Let the fraction of votes that a candidate will receive on an election day be ![xin [0,1].](https://wikimedia.org/api/rest_v1/media/math/render/svg/1c44eb6b4643a03d3c166df0e61c4925b6d4d4f0)

![[0,1]](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

As with previous example, we have

Here, both the

where the weights are given by

Here, since the denominator term is constant, the poll with lower error is given higher weight in order to predict the election outcome. Lastly, the variance of

which makes

In general, if we have

Example 4[edit]

Suppose that a musician is playing an instrument and that the sound is received by two microphones, each of them located at two different places. Let the attenuation of sound due to distance at each microphone be

We can model the sound received by each microphone as

Here both the

where the i-th weight is given as

See also[edit]

- Bayesian estimator

- Mean squared error

- Least squares

- Minimum-variance unbiased estimator (MVUE)

- Orthogonality principle

- Wiener filter

- Kalman filter

- Linear prediction

- Zero-forcing equalizer

Notes[edit]

- ^ «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 9 May 2017.

- ^ Moon and Stirling.

Further reading[edit]

- Johnson, D. «Minimum Mean Squared Error Estimators». Connexions. Archived from Minimum Mean Squared Error Estimators the original on 25 July 2008. Retrieved 8 January 2013.

- Jaynes, E.T. (2003). Probability Theory: The Logic of Science. Cambridge University Press. ISBN 978-0521592710.

- Bibby, J.; Toutenburg, H. (1977). Prediction and Improved Estimation in Linear Models. Wiley. ISBN 9780471016564.

- Lehmann, E. L.; Casella, G. (1998). «Chapter 4». Theory of Point Estimation (2nd ed.). Springer. ISBN 0-387-98502-6.

- Kay, S. M. (1993). Fundamentals of Statistical Signal Processing: Estimation Theory. Prentice Hall. pp. 344–350. ISBN 0-13-042268-1.

- Luenberger, D.G. (1969). «Chapter 4, Least-squares estimation». Optimization by Vector Space Methods (1st ed.). Wiley. ISBN 978-0471181170.

- Moon, T.K.; Stirling, W.C. (2000). Mathematical Methods and Algorithms for Signal Processing (1st ed.). Prentice Hall. ISBN 978-0201361865.

- Van Trees, H. L. (1968). Detection, Estimation, and Modulation Theory, Part I. New York: Wiley. ISBN 0-471-09517-6.

- Haykin, S.O. (2013). Adaptive Filter Theory (5th ed.). Prentice Hall. ISBN 978-0132671453.

In statistics and signal processing, a minimum mean square error (MMSE) estimator is an estimation method which minimizes the mean square error (MSE), which is a common measure of estimator quality, of the fitted values of a dependent variable. In the Bayesian setting, the term MMSE more specifically refers to estimation with quadratic loss function. In such case, the MMSE estimator is given by the posterior mean of the parameter to be estimated. Since the posterior mean is cumbersome to calculate, the form of the MMSE estimator is usually constrained to be within a certain class of functions. Linear MMSE estimators are a popular choice since they are easy to use, easy to calculate, and very versatile. It has given rise to many popular estimators such as the Wiener–Kolmogorov filter and Kalman filter.

Motivation[edit]

The term MMSE more specifically refers to estimation in a Bayesian setting with quadratic cost function. The basic idea behind the Bayesian approach to estimation stems from practical situations where we often have some prior information about the parameter to be estimated. For instance, we may have prior information about the range that the parameter can assume; or we may have an old estimate of the parameter that we want to modify when a new observation is made available; or the statistics of an actual random signal such as speech. This is in contrast to the non-Bayesian approach like minimum-variance unbiased estimator (MVUE) where absolutely nothing is assumed to be known about the parameter in advance and which does not account for such situations. In the Bayesian approach, such prior information is captured by the prior probability density function of the parameters; and based directly on Bayes theorem, it allows us to make better posterior estimates as more observations become available. Thus unlike non-Bayesian approach where parameters of interest are assumed to be deterministic, but unknown constants, the Bayesian estimator seeks to estimate a parameter that is itself a random variable. Furthermore, Bayesian estimation can also deal with situations where the sequence of observations are not necessarily independent. Thus Bayesian estimation provides yet another alternative to the MVUE. This is useful when the MVUE does not exist or cannot be found.

Definition[edit]

Let

where the expectation

The MMSE estimator is then defined as the estimator achieving minimal MSE:

Properties[edit]

- When the means and variances are finite, the MMSE estimator is uniquely defined[1] and is given by:

-

- In other words, the MMSE estimator is the conditional expectation of

given the known observed value of the measurements. Also, since

is the posterior mean, the error covariance matrix

is equal to the posterior covariance

matrix,

.

- The MMSE estimator is unbiased (under the regularity assumptions mentioned above):

- The MMSE estimator is asymptotically unbiased and it converges in distribution to the normal distribution:

-

- where

is the Fisher information of

. Thus, the MMSE estimator is asymptotically efficient.

-

- for all

in closed, linear subspace

of the measurements. For random vectors, since the MSE for estimation of a random vector is the sum of the MSEs of the coordinates, finding the MMSE estimator of a random vector decomposes into finding the MMSE estimators of the coordinates of X separately:

- for all i and j. More succinctly put, the cross-correlation between the minimum estimation error

and the estimator

should be zero,

Linear MMSE estimator[edit]

In many cases, it is not possible to determine the analytical expression of the MMSE estimator. Two basic numerical approaches to obtain the MMSE estimate depends on either finding the conditional expectation

One possibility is to abandon the full optimality requirements and seek a technique minimizing the MSE within a particular class of estimators, such as the class of linear estimators. Thus, we postulate that the conditional expectation of

One advantage of such linear MMSE estimator is that it is not necessary to explicitly calculate the posterior probability density function of

The expression for optimal

where

Thus, the expression for linear MMSE estimator, its mean, and its auto-covariance is given by

where the

Lastly, the error covariance and minimum mean square error achievable by such estimator is

Univariate case[edit]

For the special case when both

where

The above two equations allows us to interpret the correlation coefficient either as normalized slope of linear regression

or as square root of the ratio of two variances

.

When

Computation[edit]

Standard method like Gauss elimination can be used to solve the matrix equation for

Linear MMSE estimator for linear observation process[edit]

Let us further model the underlying process of observation as a linear process:

Thus the expression for the linear MMSE estimator matrix

Putting everything into the expression for

Lastly, the error covariance is

The significant difference between the estimation problem treated above and those of least squares and Gauss–Markov estimate is that the number of observations m, (i.e. the dimension of

Alternative form[edit]

An alternative form of expression can be obtained by using the matrix identity

which can be established by post-multiplying by

and

Since

In this form the above expression can be easily compared with weighed least square and Gauss–Markov estimate. In particular, when

Sequential linear MMSE estimation[edit]

In many real-time applications, observational data is not available in a single batch. Instead the observations are made in a sequence. One possible approach is to use the sequential observations to update an old estimate as additional data becomes available, leading to finer estimates. One crucial difference between batch estimation and sequential estimation is that sequential estimation requires an additional Markov assumption.

In the Bayesian framework, such recursive estimation is easily facilitated using Bayes’ rule. Given

The

This is the Markov assumption.

The MMSE estimate

In the context of linear MMSE estimator, the formula for the estimate will have the same form as before. However, the mean and covariance matrices of

The mean and covariance matrix of the prior density

respectively, as per by the property of MMSE estimators.

Similarly, for the linear observation process, the mean and covariance matrix of the likelihood

.

The difference between the predicted value of

![{displaystyle mathrm {E} [{tilde {y}}_{k}]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7333e06de208be900c7d618273db57bf678fb1f)

.

Hence, in the estimate update formula, we should replace

Thus, we have the new estimate as

and the new error covariance as

From the point of view of linear algebra, for sequential estimation, if we have an estimate

The repeated use of the above two equations as more observations become available lead to recursive estimation techniques. The expressions can be more compactly written as

The matrix

The repetition of these three steps as more data becomes available leads to an iterative estimation algorithm. The generalization of this idea to non-stationary cases gives rise to the Kalman filter. The three update steps outlined above indeed form the update step of the Kalman filter.

Special case: scalar observations[edit]

As an important special case, an easy to use recursive expression can be derived when at each k-th time instant the underlying linear observation process yields a scalar such that

where

The

Here, no matrix inversion is required. Also, the gain factor,

Alternative approaches: This important special case has also given rise to many other iterative methods (or adaptive filters), such as the least mean squares filter and recursive least squares filter, that directly solves the original MSE optimization problem using stochastic gradient descents. However, since the estimation error

where

Examples[edit]

Example 1[edit]

We shall take a linear prediction problem as an example. Let a linear combination of observed scalar random variables

![{displaystyle z=[z_{1},z_{2},z_{3},z_{4}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/45cb1f9123fdf786074088616e42dfbcc1359d07)

then our task is to find the coefficients

In terms of the terminology developed in the previous sections, for this problem we have the observation vector ![{displaystyle y=[z_{1},z_{2},z_{3}]^{T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7fdeb8eb600c7a066561d28e2b3f32fb5b1572b9)

![W=[w_{1},w_{2},w_{3}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd8e9343b228a9044dbb8208e9ceeb31270b04c1)

The cross correlation matrix

We now solve the equation

So we have

as the optimal coefficients for

mean square error then gives ![{displaystyle leftVert erightVert _{min }^{2}=operatorname {E} [z_{4}z_{4}]-WC_{YX}=15-WC_{YX}=.2857}](https://wikimedia.org/api/rest_v1/media/math/render/svg/44558ab7a0b5ead1b9571853096d800773b38877)

Example 2[edit]

Consider a vector

![1=[1,1,ldots ,1]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/43fec89f837a5e8d53869fb49ec95a9e56a788f0)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

![[-x_{0},x_{0}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e79873ca5ddfd5d6b0168f6373b33c8bc3756c69)

Thus, the linear MMSE estimator is given by

We can simplify the expression by using the alternative form for

where for ![y=[y_{1},y_{2},ldots ,y_{N}]^{T}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8317c7045e5b1318cec0c4ee89727a02cdeecafc)

Similarly, the variance of the estimator is

Thus the MMSE of this linear estimator is

For very large

while the variance will be unaffected by data

However, the estimator is suboptimal since it is constrained to be linear. Had the random variable

Example 3[edit]

Consider a variation of the above example: Two candidates are standing for an election. Let the fraction of votes that a candidate will receive on an election day be ![xin [0,1].](https://wikimedia.org/api/rest_v1/media/math/render/svg/1c44eb6b4643a03d3c166df0e61c4925b6d4d4f0)

![[0,1]](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

As with previous example, we have

Here, both the

where the weights are given by

Here, since the denominator term is constant, the poll with lower error is given higher weight in order to predict the election outcome. Lastly, the variance of

which makes

In general, if we have

Example 4[edit]

Suppose that a musician is playing an instrument and that the sound is received by two microphones, each of them located at two different places. Let the attenuation of sound due to distance at each microphone be

We can model the sound received by each microphone as

Here both the

where the i-th weight is given as

See also[edit]

- Bayesian estimator

- Mean squared error

- Least squares

- Minimum-variance unbiased estimator (MVUE)

- Orthogonality principle

- Wiener filter

- Kalman filter

- Linear prediction

- Zero-forcing equalizer

Notes[edit]

- ^ «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 9 May 2017.

- ^ Moon and Stirling.

Further reading[edit]

- Johnson, D. «Minimum Mean Squared Error Estimators». Connexions. Archived from Minimum Mean Squared Error Estimators the original on 25 July 2008. Retrieved 8 January 2013.

- Jaynes, E.T. (2003). Probability Theory: The Logic of Science. Cambridge University Press. ISBN 978-0521592710.

- Bibby, J.; Toutenburg, H. (1977). Prediction and Improved Estimation in Linear Models. Wiley. ISBN 9780471016564.

- Lehmann, E. L.; Casella, G. (1998). «Chapter 4». Theory of Point Estimation (2nd ed.). Springer. ISBN 0-387-98502-6.

- Kay, S. M. (1993). Fundamentals of Statistical Signal Processing: Estimation Theory. Prentice Hall. pp. 344–350. ISBN 0-13-042268-1.

- Luenberger, D.G. (1969). «Chapter 4, Least-squares estimation». Optimization by Vector Space Methods (1st ed.). Wiley. ISBN 978-0471181170.

- Moon, T.K.; Stirling, W.C. (2000). Mathematical Methods and Algorithms for Signal Processing (1st ed.). Prentice Hall. ISBN 978-0201361865.

- Van Trees, H. L. (1968). Detection, Estimation, and Modulation Theory, Part I. New York: Wiley. ISBN 0-471-09517-6.

- Haykin, S.O. (2013). Adaptive Filter Theory (5th ed.). Prentice Hall. ISBN 978-0132671453.

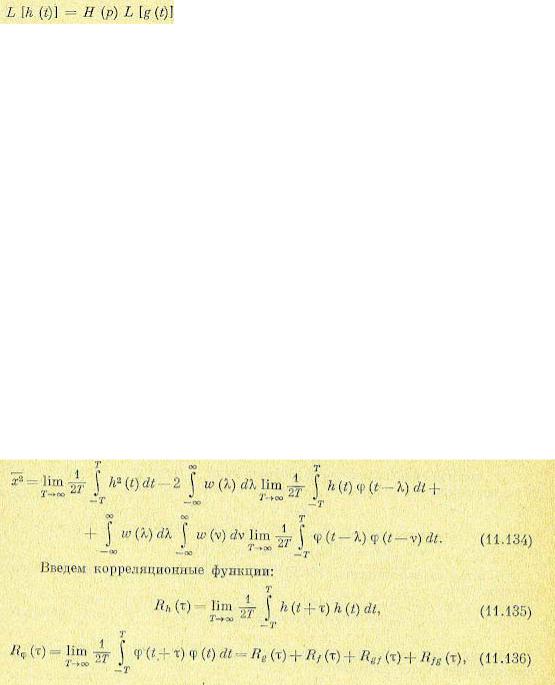

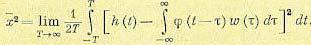

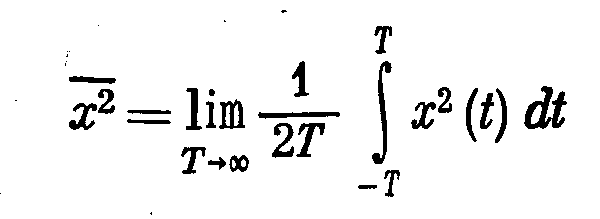

Спектральная плотность вычисляется по известной корреляционной функции при помощи формул.

Вопросы

самоконтроля:

-

Дайте

определение спектральной плотности. -

Какой

функцией является спектральная

плотность. -

Как

вычисляется спектральная плотность

по известной корреляционной функции.

Лекция 59

Цель

лекции: ознакомиться

с расчетами по минимуму среднеквадратичной

ошибки случайной величины.

Задачи лекции:

-

Расчет

по минимуму среднеквадратичной ошибки

случайной величины. -

Критерий

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Желаемый

результат:

Студенты

должны знать:

-

Расчет

по минимуму среднеквадратичной ошибки

случайной величины. -

Критерий

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

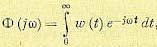

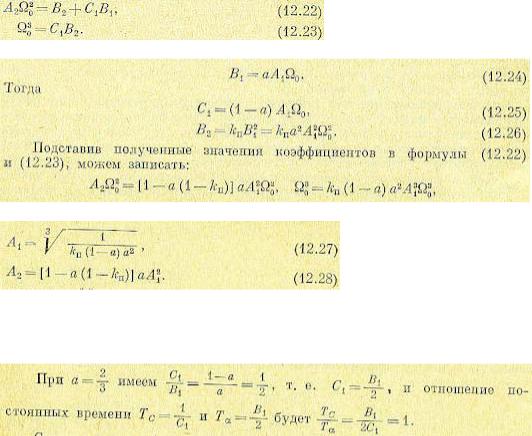

Учебный материал Расчеты по минимуму среднеквадратичной ошибки

Если

на автоматическую систему действуют

одновременно полезный сигнал и помеха,

то возникает задача оптимального расчета

системы с тем, чтобы получить наименьшую

результирующую ошибку. С точки зрения

наилучшего воспроизведения полезного

сигнала система должна иметь возможно

большую полосу пропускания, а с точки

зрения наилучшего подавления помехи

система, наоборот, должна иметь возможно

меньшую полосу пропускания. Критерием

получения оптимального решения здесь

будет минимальное значение результирующей

ошибки системы, определяемой полезным

сигналом и помехой.

Для случайных

величин наиболее просто определить

среднеквадратичную ошибку, поэтому ее

и используют для оценки точности

автоматической системы.

Рассмотрим

расчет системы по критерию

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Согласно

этому критерию, нежелательность ошибки

пропорциональна квадрату ее величины.

Такая постановка является часто логичной,

но она не может, конечно, претендовать

на полную универсальность. В некоторых

случаях например при стрельбе по

какой-либо цели, все ошибки, большие

некоторого значения, являются одинаково

нежелательными. Однако средний квадрат

ошибки системы регулирования

практически

во всех случаях является наиболее просто

вычисляемой величиной, что и определило

использование этого критерия.

Возможны

несколько формулировок задачи. Наиболее

просто задача может быть сформулирована

так. Если имеется какая-то система

автоматического регулирования

заданной структуры, то необходимо так

выбрать параметры этой системы, чтобы

получить минимум среднеквадратичной

ошибки при заданных статистических

характеристиках полезного сигнала и

помехи.

Эта

задача решается следующим образом. По

спектральной плотности ошибки путем

ее интегрирования находится дисперсия.

Дисперсия получается зависящей от

вероятностных характеристик полезного

сигнала, помехи и параметров системы.

Затем ищутся условия, которые должны

быть наложены на параметры системы,

чтобы получить минимум дисперсии. При

достаточно простом выражении для

дисперсии это может быть определено

непосредственным дифференцированием

и приравниванием нулю частных производных.

В

более сложных случаях приходится искать

минимум дисперсии путем числового

задания интересующих параметров и

построения соответствующих графиков,

а также расчетом на ЭВМ.

Нахождение

оптимальной передаточной функции еще

не означает, что реальная автоматическая

система может быть выполнена оптимальной,

так как реализация ее может быть сопряжена

с большими трудностями. Оптимальную

передаточную функцию, за исключением

простейших случаев, следует считать

идеальной функцией, к которой по

возможности надо стремиться при

выполнении реальной автоматической

системы.

Вопросы

самоконтроля:

-

Какую

величину используют для оценки точности

автоматической системы со случайными

сигналами. -

Дайте

определение критерию

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи. -

Как

определяется минимум

дисперсии.

Соседние файлы в папке лекции

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Критерий — минимум — среднеквадратичная ошибка

Cтраница 1

Критерий минимума среднеквадратичной ошибки используется для решения более сложных задач по сравнению с задачей определения оптимальных параметров при известной структуре системы.

[1]

Идея приближения по критерию минимума среднеквадратичной ошибки, как уже указывалось, не единственна.

[2]

Тх корректирующего устройства по критерию минимума среднеквадратичной ошибки, если полезный сигнал и помеха независимы и приложены к одной точке системы.

[3]

Первое из этих условий удовлетворялось и при синтезе по критерию минимума среднеквадратичной ошибки.

[4]

Адекватность полученной модели и необходимость ее коррекции оценивают чаще всего по критерию минимума среднеквадратичной ошибки. Этот метод наиболее целесообразен.

[5]

Причем объем вычислений может быть значительно уменьшен за счет незначительного ухудшения качества, фильтрации по критерию минимума среднеквадратичной ошибки.

[6]

В большинстве практически встречающихся случаев представляется возможным, хотя бы в первом приближении, рассматривать процессы изменения технологических величин или других производственных показателей как стационарные случайные функции с нормальным распределением. Поэтому обычно критерий минимума среднеквадратичной ошибки является наиболее приемлемым в качестве критерия наилучшего предсказания в большинстве рассматриваемых задач управления.

[7]

Кроме того, по критерию минимума среднеквадратичной ошибки определяются оптимальная структура и передаточная функция замкнутой системы, обеспечивающие минимальную величину погрешности.

[8]

Анализ и синтез нелинейных систем с неизвестной структурой предлагается проводить с помощью многопеременных прямоугольных функций. Практически реализуемый алгоритм с применением этих функций получен на основе критерия минимума среднеквадратичной ошибки. Алгоритм применим при входных стационарных сигналах с произвольной плотностью распределения вероятностей.

[9]

Задача заключается в оценке значений, к-рые реализация рассматриваемого процесса ( или нек-рых его параметров, таких, как ср. Здесь в большинстве случаев определяется инвариантный во времени линейный реализуемый фильтр, оптимизирующий оценку по критерию минимума среднеквадратичной ошибки. Возможны и часто желательны др. критерии, но указанный критерий отличается математич. Для решения задач такого рода часто применяется теория Винера — Колмогорова. В этой теории предполагается, что сигнал S ( t) характеризуется только статистич. Мешающий шум N ( t) представляет также чисто случайный процесс, комбинируется с сигналом аддитивно и может быть с ним связан статистически. Далее предполагается, что накопление и обработка данных совершаются только над прошлым процессов на входе, к-рые считаются стационарными в широком смысле и имеющими положительно определенные ковариант-ные ф-ции. Кроме того, в большинстве случаев реализуются оптимальные линейные фильтры, к-рые не только реализуемы, но также и инвариантны во времени. При этих условиях импульсная переходная ф-ция линейного фильтра определяется из интегр.

[10]

Задача заключается в оценке значений, к-рые реализация рассматриваемого процесса ( или нек-рых его параметров, таких, как ср. Здесь в большинство случаев определяется инвариантный во времени линейный реализуемый фильтр, оптимизирующий оценку по критерию минимума среднеквадратичной ошибки. Возможны и часто желательны др. критерии, но указанный критерий отличается математич. Для решения задач такого рода часто применяется теория Винера — Колмогорова. В этой теории предполагается, что сигнал S ( t) характеризуется только статпстич. Мешающий шум N ( t) представляет также чисто случайный процесс, комбинируется с сигналом аддитивно и может быть с ним связан статистически. Далее предполагается, что накопление и обработка данных совершаются только над прошлым процессов па входе, к-рые считаются стационарными в широком смысле и имеющими положительно определенные ковариант-ные ф-ции. Кроме того, в большинстве случаев реализуются оптимальные линейные фильтры, к-рые не только реализуемы, но также и инвариантны во времени. При этих условиях импульсная переходная ф-ция линейного фильтра определяется из интегр.

[11]

После определения среднеквадратичной ошибки необходимо обеспечить минимальное значение ее. Наиболее просто задача решается путем минимизации среднеквадратичной ошибки по тому или иному параметру системы при заданных воздействиях. В качестве параметров, которые желательно сделать оптимальными на основе критерия минимума среднеквадратичной ошибки, могут рассматриваться различные постоянные, имеющие большое значение для определения динамических свойств системы.

[12]

Страницы:

1

Анализ систем на основе критерия минимума среднеквадратичной ошибки [c.189]

Если ковариационные функции процессов Х( ) и У(/) известны точно, то можно воспользоваться винеровским критерием минимума среднеквадратичной ошибки Этот критерий утверждает, что функция /г(и) должна быть выбрана так, чтобы минимизировать среднеквадратичную ошибку шумовой компоненты, т е [c.190]

Синтез следящих систем. Одно из первых инженерных применений анализа на основе критерия минимума среднеквадратичной ошибки было сделано при синтезировании следящих систем для зенитных орудий и в радиолокационных следящих системах [5] Например, от радиолокационной следящей системы требуется, чтобы она следила за самолетом несмотря на возмущения отра- [c.189]

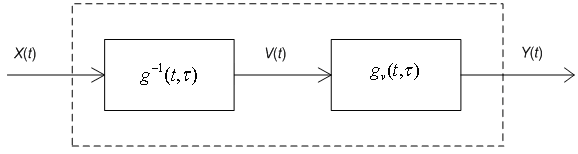

Другое применение критерий минимума среднеквадратичной ошибки находит в задаче об идентификации системы В этом случае в распоряжении имеются входной сигнал и соответствующий ему выходной сигнал от некоторой системы, требуется вывести линейное приближение к этой системе для дальнейшего его использования при управлении или моделировании Предположим, например, что система представляет собой черный ящик (рис 5 7). Если вход является реализацией случайного процесса Х 1), то выход можно рассматривать как реализацию случайного процесса У(0< где [c.190]

Оптимальное в любом смысле корреляционное окно, например (7 2 3), будет зависеть от неизвестного спектра Гхх(/). Этот недостаток свойствен не только спектральному анализу Вообще говоря, справедливо правило, согласно которому наилучший план действий должен опираться на некоторые представления об истинном положении вещей Следовательно, очень валено проводить четкое различие между планированием спектрального анализа до сбора данных и самим анализом данных, после того как они собраны Мы хотели бы использовать критерии минимума среднеквадратичной ошибки или какой-нибудь аналогичный критерий до проведения спектрального анализа, чтобы решить, например, какой длины нужно взять запись Но после того как данные собраны, могло бы оказаться, что наши представления относительно Гхх (/) были абсолютно неправильны [c.26]

Если плотность вероятности ге ([х у) симметрична относительно среднего значения гпг [х у и унимодальна (т. е. монотонно невозрастающая функция [х — /П] [х у ), то байесовская оценка (5.18) совпадает с оценкой по критерию максимума апостериорной плотности вероятности. В этом случае функция С (х) не должна быть обязательно выпуклой, а лишь монотонно неубывающей функцией х (см. приложение С). Так как нормальная плотность вероятности унимодальна, то всегда, когда плотность вероятности ге ([х I у) нормальна, оценка по максимуму апостериорной плотности вероятности совпадает с широким классом байесовских оценок, который включает оценки по минимуму среднеквадратичной ошибки (или минимуму дисперсии). [c.158]

Анализ систем на основе критерия минимума среднеквадратичной ошибки [c.189]

Если ковариационные функции процессов Х( ) и У(/) известны точно, то можно воспользоваться винеровским критерием минимума среднеквадратичной ошибки Этот критерий утверждает, что функция /г(и) должна быть выбрана так, чтобы минимизировать среднеквадратичную ошибку шумовой компоненты, т е [c.190]

Синтез следящих систем. Одно из первых инженерных применений анализа на основе критерия минимума среднеквадратичной ошибки было сделано при синтезировании следящих систем для зенитных орудий и в радиолокационных следящих системах [5] Например, от радиолокационной следящей системы требуется, чтобы она следила за самолетом несмотря на возмущения отра- [c.189]

Другое применение критерий минимума среднеквадратичной ошибки находит в задаче об идентификации системы В этом случае в распоряжении имеются входной сигнал и соответствующий ему выходной сигнал от некоторой системы, требуется вывести линейное приближение к этой системе для дальнейшего его использования при управлении или моделировании Предположим, например, что система представляет собой черный ящик (рис 5 7). Если вход является реализацией случайного процесса Х 1), то выход можно рассматривать как реализацию случайного процесса У(0< где [c.190]

Оптимальное в любом смысле корреляционное окно, например (7 2 3), будет зависеть от неизвестного спектра Гхх(/). Этот недостаток свойствен не только спектральному анализу Вообще говоря, справедливо правило, согласно которому наилучший план действий должен опираться на некоторые представления об истинном положении вещей Следовательно, очень валено проводить четкое различие между планированием спектрального анализа до сбора данных и самим анализом данных, после того как они собраны Мы хотели бы использовать критерии минимума среднеквадратичной ошибки или какой-нибудь аналогичный критерий до проведения спектрального анализа, чтобы решить, например, какой длины нужно взять запись Но после того как данные собраны, могло бы оказаться, что наши представления относительно Гхх (/) были абсолютно неправильны [c.26]

Если плотность вероятности ге ([х у) симметрична относительно среднего значения гпг [х у и унимодальна (т. е. монотонно невозрастающая функция [х — /П] [х у ), то байесовская оценка (5.18) совпадает с оценкой по критерию максимума апостериорной плотности вероятности. В этом случае функция С (х) не должна быть обязательно выпуклой, а лишь монотонно неубывающей функцией х (см. приложение С). Так как нормальная плотность вероятности унимодальна, то всегда, когда плотность вероятности ге ([х I у) нормальна, оценка по максимуму апостериорной плотности вероятности совпадает с широким классом байесовских оценок, который включает оценки по минимуму среднеквадратичной ошибки (или минимуму дисперсии). [c.158]

From Wikipedia, the free encyclopedia

In statistics, the mean squared error (MSE)[1] or mean squared deviation (MSD) of an estimator (of a procedure for estimating an unobserved quantity) measures the average of the squares of the errors—that is, the average squared difference between the estimated values and the actual value. MSE is a risk function, corresponding to the expected value of the squared error loss.[2] The fact that MSE is almost always strictly positive (and not zero) is because of randomness or because the estimator does not account for information that could produce a more accurate estimate.[3] In machine learning, specifically empirical risk minimization, MSE may refer to the empirical risk (the average loss on an observed data set), as an estimate of the true MSE (the true risk: the average loss on the actual population distribution).

The MSE is a measure of the quality of an estimator. As it is derived from the square of Euclidean distance, it is always a positive value that decreases as the error approaches zero.

The MSE is the second moment (about the origin) of the error, and thus incorporates both the variance of the estimator (how widely spread the estimates are from one data sample to another) and its bias (how far off the average estimated value is from the true value).[citation needed] For an unbiased estimator, the MSE is the variance of the estimator. Like the variance, MSE has the same units of measurement as the square of the quantity being estimated. In an analogy to standard deviation, taking the square root of MSE yields the root-mean-square error or root-mean-square deviation (RMSE or RMSD), which has the same units as the quantity being estimated; for an unbiased estimator, the RMSE is the square root of the variance, known as the standard error.

Definition and basic properties[edit]

The MSE either assesses the quality of a predictor (i.e., a function mapping arbitrary inputs to a sample of values of some random variable), or of an estimator (i.e., a mathematical function mapping a sample of data to an estimate of a parameter of the population from which the data is sampled). The definition of an MSE differs according to whether one is describing a predictor or an estimator.

Predictor[edit]

If a vector of

In other words, the MSE is the mean

In matrix notation,

where

The MSE can also be computed on q data points that were not used in estimating the model, either because they were held back for this purpose, or because these data have been newly obtained. Within this process, known as statistical learning, the MSE is often called the test MSE,[4] and is computed as

Estimator[edit]

The MSE of an estimator

This definition depends on the unknown parameter, but the MSE is a priori a property of an estimator. The MSE could be a function of unknown parameters, in which case any estimator of the MSE based on estimates of these parameters would be a function of the data (and thus a random variable). If the estimator

The MSE can be written as the sum of the variance of the estimator and the squared bias of the estimator, providing a useful way to calculate the MSE and implying that in the case of unbiased estimators, the MSE and variance are equivalent.[5]

Proof of variance and bias relationship[edit]

An even shorter proof can be achieved using the well-known formula that for a random variable

But in real modeling case, MSE could be described as the addition of model variance, model bias, and irreducible uncertainty (see Bias–variance tradeoff). According to the relationship, the MSE of the estimators could be simply used for the efficiency comparison, which includes the information of estimator variance and bias. This is called MSE criterion.

In regression[edit]

In regression analysis, plotting is a more natural way to view the overall trend of the whole data. The mean of the distance from each point to the predicted regression model can be calculated, and shown as the mean squared error. The squaring is critical to reduce the complexity with negative signs. To minimize MSE, the model could be more accurate, which would mean the model is closer to actual data. One example of a linear regression using this method is the least squares method—which evaluates appropriateness of linear regression model to model bivariate dataset,[6] but whose limitation is related to known distribution of the data.

The term mean squared error is sometimes used to refer to the unbiased estimate of error variance: the residual sum of squares divided by the number of degrees of freedom. This definition for a known, computed quantity differs from the above definition for the computed MSE of a predictor, in that a different denominator is used. The denominator is the sample size reduced by the number of model parameters estimated from the same data, (n−p) for p regressors or (n−p−1) if an intercept is used (see errors and residuals in statistics for more details).[7] Although the MSE (as defined in this article) is not an unbiased estimator of the error variance, it is consistent, given the consistency of the predictor.

In regression analysis, «mean squared error», often referred to as mean squared prediction error or «out-of-sample mean squared error», can also refer to the mean value of the squared deviations of the predictions from the true values, over an out-of-sample test space, generated by a model estimated over a particular sample space. This also is a known, computed quantity, and it varies by sample and by out-of-sample test space.

Examples[edit]

Mean[edit]

Suppose we have a random sample of size

which has an expected value equal to the true mean

where

For a Gaussian distribution, this is the best unbiased estimator (i.e., one with the lowest MSE among all unbiased estimators), but not, say, for a uniform distribution.

Variance[edit]

The usual estimator for the variance is the corrected sample variance:

This is unbiased (its expected value is

where

However, one can use other estimators for

then we calculate:

This is minimized when

For a Gaussian distribution, where

Further, while the corrected sample variance is the best unbiased estimator (minimum mean squared error among unbiased estimators) of variance for Gaussian distributions, if the distribution is not Gaussian, then even among unbiased estimators, the best unbiased estimator of the variance may not be

Gaussian distribution[edit]

The following table gives several estimators of the true parameters of the population, μ and σ2, for the Gaussian case.[9]

| True value | Estimator | Mean squared error |

|---|---|---|

|

= the unbiased estimator of the population mean, = the unbiased estimator of the population mean,  |

|

|

= the unbiased estimator of the population variance, = the unbiased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

Interpretation[edit]

An MSE of zero, meaning that the estimator

Values of MSE may be used for comparative purposes. Two or more statistical models may be compared using their MSEs—as a measure of how well they explain a given set of observations: An unbiased estimator (estimated from a statistical model) with the smallest variance among all unbiased estimators is the best unbiased estimator or MVUE (Minimum-Variance Unbiased Estimator).

Both analysis of variance and linear regression techniques estimate the MSE as part of the analysis and use the estimated MSE to determine the statistical significance of the factors or predictors under study. The goal of experimental design is to construct experiments in such a way that when the observations are analyzed, the MSE is close to zero relative to the magnitude of at least one of the estimated treatment effects.

In one-way analysis of variance, MSE can be calculated by the division of the sum of squared errors and the degree of freedom. Also, the f-value is the ratio of the mean squared treatment and the MSE.

MSE is also used in several stepwise regression techniques as part of the determination as to how many predictors from a candidate set to include in a model for a given set of observations.

Applications[edit]

- Minimizing MSE is a key criterion in selecting estimators: see minimum mean-square error. Among unbiased estimators, minimizing the MSE is equivalent to minimizing the variance, and the estimator that does this is the minimum variance unbiased estimator. However, a biased estimator may have lower MSE; see estimator bias.

- In statistical modelling the MSE can represent the difference between the actual observations and the observation values predicted by the model. In this context, it is used to determine the extent to which the model fits the data as well as whether removing some explanatory variables is possible without significantly harming the model’s predictive ability.

- In forecasting and prediction, the Brier score is a measure of forecast skill based on MSE.

Loss function[edit]

Squared error loss is one of the most widely used loss functions in statistics[citation needed], though its widespread use stems more from mathematical convenience than considerations of actual loss in applications. Carl Friedrich Gauss, who introduced the use of mean squared error, was aware of its arbitrariness and was in agreement with objections to it on these grounds.[3] The mathematical benefits of mean squared error are particularly evident in its use at analyzing the performance of linear regression, as it allows one to partition the variation in a dataset into variation explained by the model and variation explained by randomness.

Criticism[edit]

The use of mean squared error without question has been criticized by the decision theorist James Berger. Mean squared error is the negative of the expected value of one specific utility function, the quadratic utility function, which may not be the appropriate utility function to use under a given set of circumstances. There are, however, some scenarios where mean squared error can serve as a good approximation to a loss function occurring naturally in an application.[10]

Like variance, mean squared error has the disadvantage of heavily weighting outliers.[11] This is a result of the squaring of each term, which effectively weights large errors more heavily than small ones. This property, undesirable in many applications, has led researchers to use alternatives such as the mean absolute error, or those based on the median.

See also[edit]

- Bias–variance tradeoff

- Hodges’ estimator

- James–Stein estimator

- Mean percentage error

- Mean square quantization error

- Mean square weighted deviation

- Mean squared displacement

- Mean squared prediction error

- Minimum mean square error

- Minimum mean squared error estimator

- Overfitting

- Peak signal-to-noise ratio

Notes[edit]

- ^ This can be proved by Jensen’s inequality as follows. The fourth central moment is an upper bound for the square of variance, so that the least value for their ratio is one, therefore, the least value for the excess kurtosis is −2, achieved, for instance, by a Bernoulli with p=1/2.

References[edit]

- ^ a b «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 2020-09-12.

- ^ Bickel, Peter J.; Doksum, Kjell A. (2015). Mathematical Statistics: Basic Ideas and Selected Topics. Vol. I (Second ed.). p. 20.

If we use quadratic loss, our risk function is called the mean squared error (MSE) …

- ^ a b Lehmann, E. L.; Casella, George (1998). Theory of Point Estimation (2nd ed.). New York: Springer. ISBN 978-0-387-98502-2. MR 1639875.

- ^ Gareth, James; Witten, Daniela; Hastie, Trevor; Tibshirani, Rob (2021). An Introduction to Statistical Learning: with Applications in R. Springer. ISBN 978-1071614174.

- ^ Wackerly, Dennis; Mendenhall, William; Scheaffer, Richard L. (2008). Mathematical Statistics with Applications (7 ed.). Belmont, CA, USA: Thomson Higher Education. ISBN 978-0-495-38508-0.

- ^ A modern introduction to probability and statistics : understanding why and how. Dekking, Michel, 1946-. London: Springer. 2005. ISBN 978-1-85233-896-1. OCLC 262680588.

{{cite book}}: CS1 maint: others (link) - ^ Steel, R.G.D, and Torrie, J. H., Principles and Procedures of Statistics with Special Reference to the Biological Sciences., McGraw Hill, 1960, page 288.

- ^ Mood, A.; Graybill, F.; Boes, D. (1974). Introduction to the Theory of Statistics (3rd ed.). McGraw-Hill. p. 229.

- ^ DeGroot, Morris H. (1980). Probability and Statistics (2nd ed.). Addison-Wesley.

- ^ Berger, James O. (1985). «2.4.2 Certain Standard Loss Functions». Statistical Decision Theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. p. 60. ISBN 978-0-387-96098-2. MR 0804611.

- ^ Bermejo, Sergio; Cabestany, Joan (2001). «Oriented principal component analysis for large margin classifiers». Neural Networks. 14 (10): 1447–1461. doi:10.1016/S0893-6080(01)00106-X. PMID 11771723.

Спектральная плотность вычисляется по известной корреляционной функции при помощи формул.

Вопросы

самоконтроля:

-

Дайте

определение спектральной плотности. -

Какой

функцией является спектральная

плотность. -

Как

вычисляется спектральная плотность

по известной корреляционной функции.

Лекция 59

Цель

лекции: ознакомиться

с расчетами по минимуму среднеквадратичной

ошибки случайной величины.

Задачи лекции:

-

Расчет

по минимуму среднеквадратичной ошибки

случайной величины. -

Критерий

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Желаемый

результат:

Студенты

должны знать:

-

Расчет

по минимуму среднеквадратичной ошибки

случайной величины. -

Критерий

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Учебный материал Расчеты по минимуму среднеквадратичной ошибки

Если

на автоматическую систему действуют

одновременно полезный сигнал и помеха,

то возникает задача оптимального расчета

системы с тем, чтобы получить наименьшую

результирующую ошибку. С точки зрения

наилучшего воспроизведения полезного

сигнала система должна иметь возможно

большую полосу пропускания, а с точки

зрения наилучшего подавления помехи

система, наоборот, должна иметь возможно

меньшую полосу пропускания. Критерием

получения оптимального решения здесь

будет минимальное значение результирующей

ошибки системы, определяемой полезным

сигналом и помехой.

Для случайных

величин наиболее просто определить

среднеквадратичную ошибку, поэтому ее

и используют для оценки точности

автоматической системы.

Рассмотрим

расчет системы по критерию

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи.

Согласно

этому критерию, нежелательность ошибки

пропорциональна квадрату ее величины.

Такая постановка является часто логичной,

но она не может, конечно, претендовать

на полную универсальность. В некоторых

случаях например при стрельбе по

какой-либо цели, все ошибки, большие

некоторого значения, являются одинаково

нежелательными. Однако средний квадрат

ошибки системы регулирования

практически

во всех случаях является наиболее просто

вычисляемой величиной, что и определило

использование этого критерия.

Возможны

несколько формулировок задачи. Наиболее

просто задача может быть сформулирована

так. Если имеется какая-то система

автоматического регулирования

заданной структуры, то необходимо так

выбрать параметры этой системы, чтобы

получить минимум среднеквадратичной

ошибки при заданных статистических

характеристиках полезного сигнала и

помехи.

Эта

задача решается следующим образом. По

спектральной плотности ошибки путем

ее интегрирования находится дисперсия.

Дисперсия получается зависящей от

вероятностных характеристик полезного

сигнала, помехи и параметров системы.

Затем ищутся условия, которые должны

быть наложены на параметры системы,

чтобы получить минимум дисперсии. При

достаточно простом выражении для

дисперсии это может быть определено

непосредственным дифференцированием

и приравниванием нулю частных производных.

В

более сложных случаях приходится искать

минимум дисперсии путем числового

задания интересующих параметров и

построения соответствующих графиков,

а также расчетом на ЭВМ.

Нахождение

оптимальной передаточной функции еще

не означает, что реальная автоматическая

система может быть выполнена оптимальной,

так как реализация ее может быть сопряжена

с большими трудностями. Оптимальную

передаточную функцию, за исключением

простейших случаев, следует считать

идеальной функцией, к которой по

возможности надо стремиться при

выполнении реальной автоматической

системы.

Вопросы

самоконтроля:

-

Какую

величину используют для оценки точности

автоматической системы со случайными

сигналами. -

Дайте

определение критерию

минимума среднеквадратичной ошибки

при одновременном действии полезного

сигнала и помехи. -

Как

определяется минимум

дисперсии.

Соседние файлы в папке лекции

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

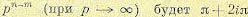

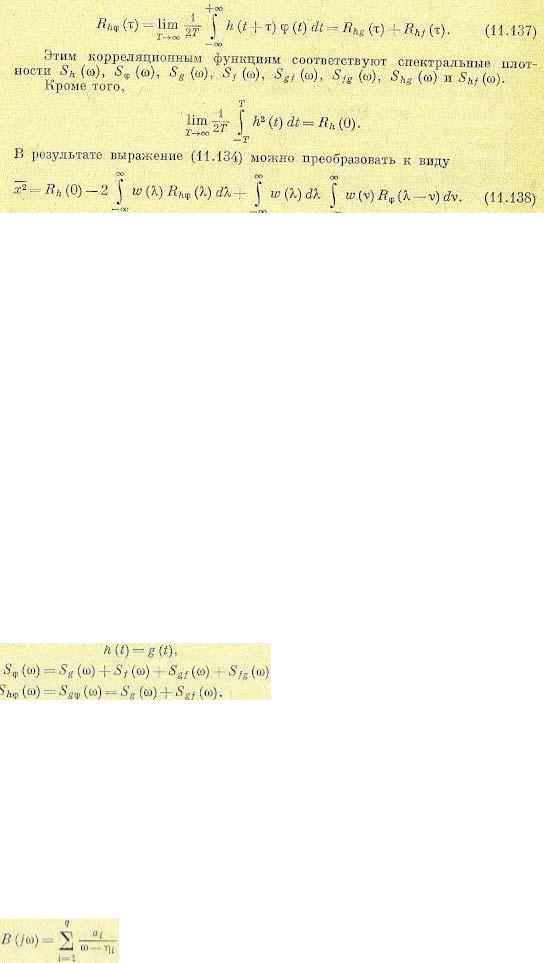

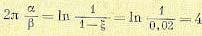

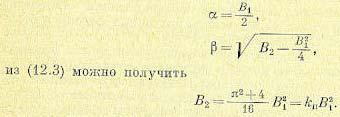

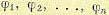

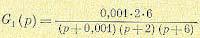

Применим закон распределения равновероятности:

(4)

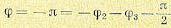

Подставляя (1) и (2) и (4) и вводя обозначения с фазой

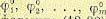

Последовательная схема может быть

также реализована на основе СФ.

Нормальные

и аномальные ошибки.

Необходимо рассматривать

,

тогда

если ,

либо соответствует

, то

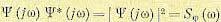

Эта же задача стоит при

радиоизмерениях. И она может решаться при построении оптимального устройства, с

различными критериями.

Статистические

критерии оценки непрерывных параметров

сигнала.

Cуществуют

следующие критерии:

ü

Критерий максимума функции правдоподобия.

ü

максимальная апостериорная плотность распределения вероятности

параметра .

ü

Критерий минимума средне квадратичной ошибки.

ü

Критерий Баеса.

Распишем каждый критерий более

подробно.

Критерий максимального

правдоподобия.

максимального правдоподобия.

Критерий максимальной

апостериорной вероятности.

Рассмотрим статистическую схему:

Оценивается значение

максимального параметра.

Критерий минимальной средне

квадратичной ошибки.

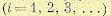

Ошибки, связанные с фиксацией , не выходящие за пределы

корреляционного пика называются нормальные ошибки (инстр. ошибки,

ошибки шума).

Шумовая составляющая:

Дисперсия:

Шумовая составляющая имеет вид , но её особенность, что

количество сигнальных выбросов тем больше, чем больше шумовой уровень.

При регистрации шумовой выброс

может быть принят за сигнальный выброс. Ошибка может составить , а нормальные ошибки не выходят за

корреляционные пределы. Вероятность появления аномальных ошибок характеризует

неправильность измерения вообще.

При проектировании задают

соотношение сигнал/шум, чтобы избежать аномальных ошибок.

А среднеквадратичная ошибка

параметра .

Расчёт среднеквадратической ошибки.

Рассмотрим формулу исходя из

геометрического происхождения сигнала.

In statistics and signal processing, a minimum mean square error (MMSE) estimator is an estimation method which minimizes the mean square error (MSE), which is a common measure of estimator quality, of the fitted values of a dependent variable. In the Bayesian setting, the term MMSE more specifically refers to estimation with quadratic loss function. In such case, the MMSE estimator is given by the posterior mean of the parameter to be estimated. Since the posterior mean is cumbersome to calculate, the form of the MMSE estimator is usually constrained to be within a certain class of functions. Linear MMSE estimators are a popular choice since they are easy to use, easy to calculate, and very versatile. It has given rise to many popular estimators such as the Wiener–Kolmogorov filter and Kalman filter.

Motivation[edit]

The term MMSE more specifically refers to estimation in a Bayesian setting with quadratic cost function. The basic idea behind the Bayesian approach to estimation stems from practical situations where we often have some prior information about the parameter to be estimated. For instance, we may have prior information about the range that the parameter can assume; or we may have an old estimate of the parameter that we want to modify when a new observation is made available; or the statistics of an actual random signal such as speech. This is in contrast to the non-Bayesian approach like minimum-variance unbiased estimator (MVUE) where absolutely nothing is assumed to be known about the parameter in advance and which does not account for such situations. In the Bayesian approach, such prior information is captured by the prior probability density function of the parameters; and based directly on Bayes theorem, it allows us to make better posterior estimates as more observations become available. Thus unlike non-Bayesian approach where parameters of interest are assumed to be deterministic, but unknown constants, the Bayesian estimator seeks to estimate a parameter that is itself a random variable. Furthermore, Bayesian estimation can also deal with situations where the sequence of observations are not necessarily independent. Thus Bayesian estimation provides yet another alternative to the MVUE. This is useful when the MVUE does not exist or cannot be found.

Definition[edit]

Let

where the expectation

The MMSE estimator is then defined as the estimator achieving minimal MSE:

Properties[edit]

- When the means and variances are finite, the MMSE estimator is uniquely defined[1] and is given by:

-

- In other words, the MMSE estimator is the conditional expectation of

given the known observed value of the measurements. Also, since

is the posterior mean, the error covariance matrix

is equal to the posterior covariance

matrix,

.

- The MMSE estimator is unbiased (under the regularity assumptions mentioned above):

- The MMSE estimator is asymptotically unbiased and it converges in distribution to the normal distribution:

-

- where

is the Fisher information of

. Thus, the MMSE estimator is asymptotically efficient.

-

- for all

in closed, linear subspace

of the measurements. For random vectors, since the MSE for estimation of a random vector is the sum of the MSEs of the coordinates, finding the MMSE estimator of a random vector decomposes into finding the MMSE estimators of the coordinates of X separately:

- for all i and j. More succinctly put, the cross-correlation between the minimum estimation error

and the estimator

should be zero,

Linear MMSE estimator[edit]

In many cases, it is not possible to determine the analytical expression of the MMSE estimator. Two basic numerical approaches to obtain the MMSE estimate depends on either finding the conditional expectation

One possibility is to abandon the full optimality requirements and seek a technique minimizing the MSE within a particular class of estimators, such as the class of linear estimators. Thus, we postulate that the conditional expectation of

One advantage of such linear MMSE estimator is that it is not necessary to explicitly calculate the posterior probability density function of

The expression for optimal

where

Thus, the expression for linear MMSE estimator, its mean, and its auto-covariance is given by

where the

Lastly, the error covariance and minimum mean square error achievable by such estimator is

Univariate case[edit]

For the special case when both

where

The above two equations allows us to interpret the correlation coefficient either as normalized slope of linear regression

or as square root of the ratio of two variances

.

When

Computation[edit]

Standard method like Gauss elimination can be used to solve the matrix equation for

Linear MMSE estimator for linear observation process[edit]

Let us further model the underlying process of observation as a linear process:

Thus the expression for the linear MMSE estimator matrix

Putting everything into the expression for

Lastly, the error covariance is

The significant difference between the estimation problem treated above and those of least squares and Gauss–Markov estimate is that the number of observations m, (i.e. the dimension of

Alternative form[edit]

An alternative form of expression can be obtained by using the matrix identity

which can be established by post-multiplying by

and

Since

In this form the above expression can be easily compared with weighed least square and Gauss–Markov estimate. In particular, when

Sequential linear MMSE estimation[edit]